Introduzione: Sapphire Technology–>

Una linea di GPU uscita in concomitanza con la serie Rx 300 è la serie Fiji, caratterizzata al momento da 3 schede video di fascia alta: la R9 Fury, la R9 Fury X e la R9 Nano.

Mentre queste ultime due sono caratterizzate da un prezzo di 649$ (720€) e sono mosse dalla stessa GPU Fiji XT, la prima è una versione ridotta nel numero di Stream Processors, che invece dei soliti 4096 sono “solo” 3584. Sapphire, insieme ad Asus, è uno degli unici due partner ad offrire soluzioni custom per questa GPU. Oggi andiamo ad analizzare la versione Tri-X OC della Radeon R9 Fury, che si differenzia dal modello reference per un overclock di 40 MHz sulla GPU, ed è mossa dallo stesso tipo di memorie HBM di quest’ultima.

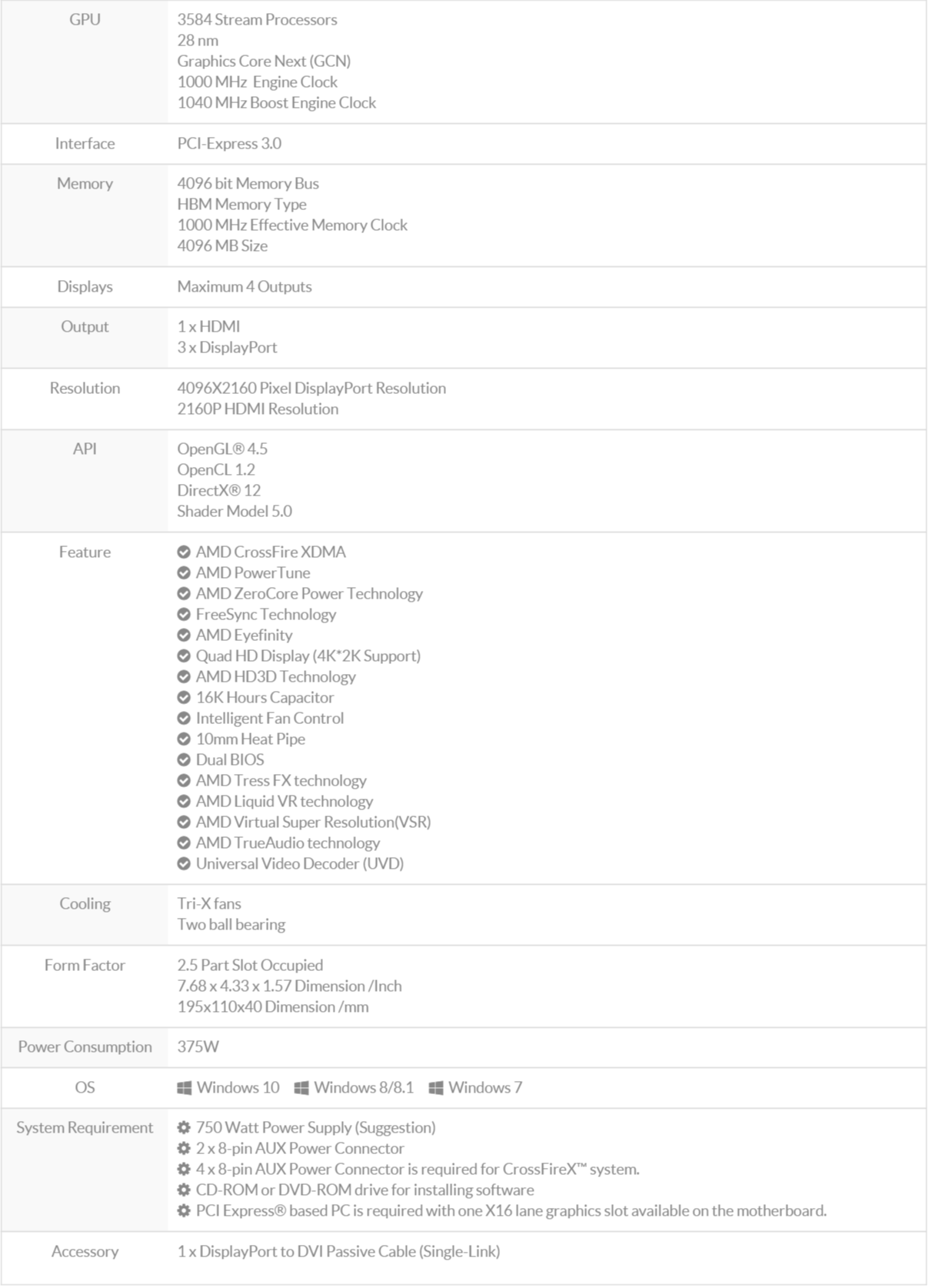

Sapphire Radeon R9 Fury Tri-X OC 4GB HBM: specifiche tecniche–>

Di seguito, una tabella delle specifiche della scheda video. Ulteriori informazioni sono disponibili sul sito del produttore (Sapphire):

Basata sulla GPU Fiji, la Sapphire Radeon R9 Fury Tri-X OC dispone di ben 3584 Stream Processors, con un bus da ben 4096 bit che collega alle memorie HBM, 4 GB con una frequenza effettiva di 1 GHz. Parleremo delle memorie HBM e di come sono collegate al processore grafico nelle prossime pagine, soffermiamoci intanto sulla scheda di Sapphire: il dissipatore è di tipo custom, il famigerato Tri-X che muove la gran parte delle schede video di fascia alta dell’azienda, con uno shroud rinnovato in concomitanza con l’uscita delle schede Rx 300 e Fury.

Come sarà possibile vedere nelle foto della prossima pagina, il dissipatore ha dimensioni pari a circa 2 volte il PCB, complice il fatto che la scheda utilizza lo stesso PCB della Fury X, presentando quindi un design reference. L’enorme corpo lamellare si occupa di raffreddare i circa 260W generati dalla GPU, svolgendo nel migliore dei modi il compito tanto difficile.

Altra novità importante di questa linea di GPU è l’abbandono dello standard DVI, con 3 porte DisplayPort ed una HDMI a popolare il pannello outputs. Purtroppo, la scheda non è compatibile con lo standard HDMI 2.0, rendendo impraticabile la visualizzazione di contenuti in 4k60 su questo standard. Per utilizzare correttamente un monitor 2160p60 dovrete utilizzare una DisplayPort o, all’evenienza, un adattatore DP-to-HDMI.

Galleria fotografica: Sapphire Radeon R9 Fury Tri-X OC 4GB HBM–>

Di seguito, una galleria di foto della scheda video e del bundle:

L’architettura nei dettagli: Fiji–>

L’architettura GCN di AMD ancora oggi continua ad innovarsi, rimanendo di fatto sempre la stessa architettura che, con l’avvento della serie HD7000, ha rivoluzionato la computazione delle schede grafiche AMD, passando da un processo seriale ad uno fortemente parallelo. Gli stessi principi base muovono questa incarnazione, GCN 1.2, così come le precedenti, e la cosa potrebbe ritorcersi contro AMD con l’avvento delle DX12. O forse no.

Come già anticipato, Fiji è essenzialmente una GPU Tonga up-scalata, ovvero ingigantita. Ciò significa che molti sono gli elementi in comune con Hawaii/Grenada, che si basano su GCN 1.1, ma l’efficienza qui viene gestita meglio, grazie anche ad un refinement del processo produttivo a 28nm sviluppatosi negli ultimi due anni. Perché GCN 1.2, e non rimanere su GCN 1.1 per ottimizzare i costi? Semplice, HBM. Ma di questo nuovo tipo di memorie, parleremo nella pagina successiva.

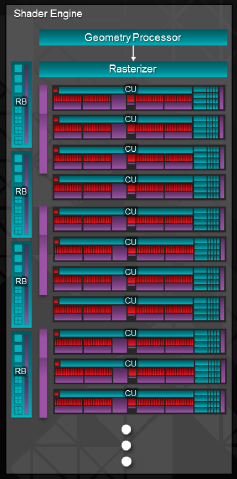

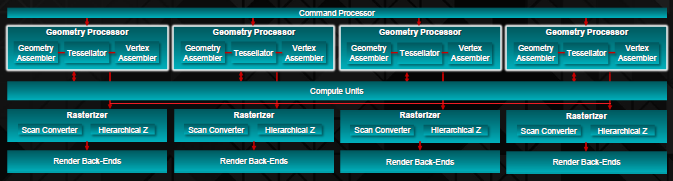

Sul fronte del layout, non ci sono molte differenze rispetto alle generazioni. Come Hawaii, esso utilizza un quartetto di Shader Engines che portano con sé Geometry Processors, Rasterizzatori, ROPs (attraverso il back-end di rendering) e le Compute Units. Nel frattempo, ogni CU mantiene le usuali 64 unità di elaborazione (stream processors) e un quartetto di Texture Units insieme ai rispettivi blocchi di caching, quindi sul fronte fisico non è cambiato molto. Non pensate, ovviamente, che AMD abbia preso Hawaii, l’abbia rinominato in GCN 1.2 e sia finita lì.

Una delle prime cose che AMD ha fatto per creare Fiji è stata allargare le Compute Unit in ogni Shader Engine. Paragonato a Hawaii/Grenada, ci sono 5 addizionali CU per engine, equivalenti a 325 stream processors in più, 20 TMUs in più e naturalmente più capacità di caching on-die.

Sicuramente il maggior cambiamento è stata l’aggiunta dell’HBM e tutte le modifiche atte ad assicurare che ci fosse abbastanza bandwidth per giustificarne la presenza. Per ottemperare alla cosa, AMD ha raddoppiato la Cache L2 da 1MB a 2MB e ha istituito avanzati algoritmi di compressione del colore senza perdita per letture e scritture in memoria. Ovviamente, ci sono anche 8 memory controller da 512 bit che possono processare un mastodontico carico di informazioni ed inviarle al quartetto di moduli da 1 GB di memoria HBM.

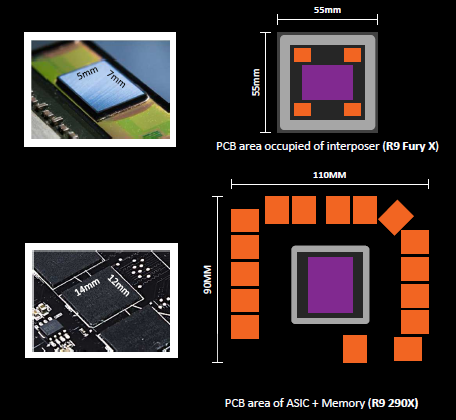

Tutto ciò ha incrementato la conta dei transistors da 6.2 miliardi di Hawaii a 8.9 miliardi di Fiji. Ciò equivale a 596 mm² per il die e 1011 mm² per tutto il sistema formato da Interposer e GPU. Ironicamente, nella GPU troviamo l’eredità di Hawaii nei DSP TrueAudio, tecnologia che sembra essere stata abbandonata da AMD.

Per mantenere i consumi di corrente al minimo nonostante il gargantuesco die, AMD ha convertito la produzione ad un processo produttivo di 28 nm fortemente ottimizzato. Ciò ha permesso di aumentare la conta dei transistors del 44% mantenendo però l’incremento delle dimensioni su soli 35%. La maturità del processo produttivo a 28nm ha contribuito anche all’efficienza elevata dei transistors e ai consumi ridotti. Alcuni insiders hanno rivelato che AMD ha ridotto le previsioni sul TDP numerose volte nel corso del tempo durante la progettazione di questa nuova GPU.

Guardando le immagini una cosa che si nota è il fatto che i Render Back-ends che contengono ROP e altre funzioni terziarie di output sono rimaste invariate. Sono ancora 4 per Shader Engine che è lo stesso numero che ritroviamo su Hawaii. Ad un primo sguardo ciò potrebbe essere preoccupante in quanto potrebbe diventare un collo di bottiglia in alcuni giochi.

Secondo AMD, qualsiasi tipo di collo di bottiglia dovuto ad un numero stagnante di ROP è stato mitigato tramite una serie di modifiche importanti. Le ROPs sono capaci di processare 16bit per clock, valore uguale a quello ritrovato su Hawaii, ma stavolta possono funzionare alla massima potenza grazie alle HBM e alle suddette routine di compressione colore. Ci sono state anche altre aggiunte così come nuove capacità elaborative delle ROPs, ed il risultato è che Fiji ha una potenza Fill-rate più che doppia rispetto ad Hawaii.

AMD ha anche modificato alcuni elementi nei CE: ci sono nuove istruzioni per l’elaborazione dati che permettono la condivisione parallela di essi attraverso le SIMD, nuove istruzioni Floating Point a 16 bit e Integer, raddoppiando poi la cache effettiva per ogni CU.

Un’altra area che non ha alcun cambiamento visibile è lo stadio di elaborazione geometrie, ma ancora una volta i cambiamenti si nascondono sotto la facciata: ci sono sempre 4 processori contenenti assemblers (che traducono le istruzioni in linguaggio macchina) e tessellators (che popolano i wireframe nei giochi DX11) ma ogni unità ha ricevuto un incremento prestazionale, migliorando quindi le performance in tessellation.

Per ultimo ma non per importanza, AMD ha migliorato il throughput dei suoi ACE (Async Compute Engines) lavorando sulla corretta prioritizzazione dei dati sulla Crossbar condivisa dai 4 elementi. Tali modifiche dovrebbero aiutare AMD in ambienti DX12 con carichi elevati.

L’architettura nei dettagli: HBM, cosa sono?–>

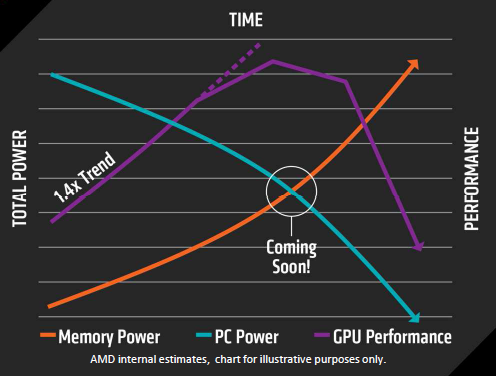

Le HBM sono state etichettate, fin dal loro annuncio, come la tecnologia chiave di prossima generazione sia per i System on Chip che per le schede grafiche. I vantaggi offerti sono un significante aumento della banda passante ed una riduzione dello spazio occupato rispetto alle soluzioni GDDR. AMD ha sviluppato HBM negli ultimi 7 anni e Fiji funge, in un certo senso, come un dimostratore tecnologico del concetto di High Bandwidth Memory, come preambolo di ciò che aspetta il futuro. NVIDIA, infatti, ha intenzione di utilizzare tale tipo di memorie (nella seconda generazione) con l’architettura Pascal.

Con i consumi al centro dell’attenzione per gli utenti enthusiast dediti al gaming, gli ingegneri AMD hanno disperatamente cercato tutti i modi per migliorare il design dei componenti aumentando al tempo stesso le prestazioni. Per farla semplice, anche le schede video di fascia ultra-high end scalano fino ad un certo punto se sono castrati dal consumo di corrente e dalla produzione di calore di altri componenti onboard.

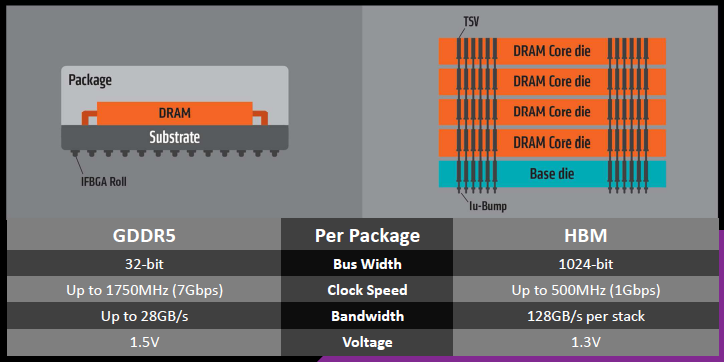

È qui che le GDDR5 entrano in gioco: secondo AMD, il mercato stava raggiungendo velocemente un punto di non ritorno dove il consumo ed il calore dei moduli di memoria avrebbero inficiato negativamente sulle prestazioni di GPU sempre più veloci. Difatti, maggiore è la velocità delle GDDR5, più potente dev’essere il segnale e più robusto dev’essere il Memory Controller integrato. Ciò significa che velocità maggiori possono essere raggiunte (moduli a 8 GHz GDDR5 sono in fase di finalizzazione) ma andando avanti, il dispendio di R&D e di corrente onboard non giustificherebbe il ridotto aumento prestazionale.

Ovviamente, non fraintendete: le GDDR5 sono lontane dall’essere vicine alla sostituzione. Tuttavia, l’efficienza delle memorie, il throughput, la potenza del segnale ed inerenti limitazioni delle attuali tecnologie delle memorie avevano bisogno di essere indirizzate qualora ci fosse stato qualche passo avanti verso le prossime generazioni di GPU. Ecco che qui HBM ha la possibilità di brillare.

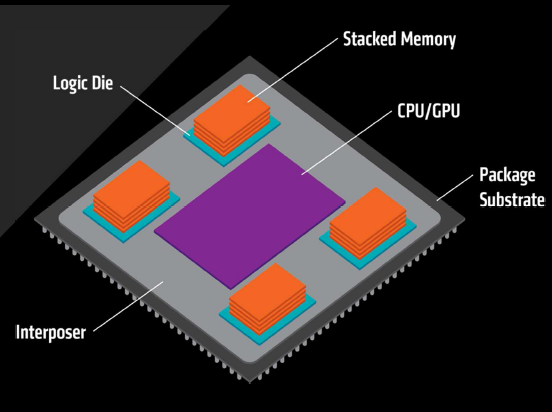

Al contrario dei precedenti design di memoria che richiedevano complicate tracce sul PCB e componenti PWM secondarie, i moduli HBM risiedono incredibilmente vicino alle unità di elaborazione, siano esse GPU, CPU o SoC. Esse comunicano tramite un interposer ad alte prestazioni ed il loro circuito logico proprio, provvedendo una via velocissima tra tutti i punti critici per i dati. Questa combinazione di processore e memoria crea un package compatto ma che non può essere modificato dalle terze parti.

Visto che gli stream di comunicazione tra core e memorie sono drasticamente accorciati, c’è un aumento inerente nell’efficienza energetica. Parte di essa proviene dal fatto di abbassare la suddetta potenza di segnale; non c’è più bisogno di aumentare enormemente le frequenze perché le componenti sono davvero molto vicine, fisicamente parlando.

Il risultato finale dell’efficienza dell’HBM parla da solo: AMD dichiara un aumento dell’efficienza di almeno il 50% contro le GDDR5 a 6 Gbps, portando con sé allo stesso tempo un aumento della banda del 60%. Ovviamente, ciò porta ad enormi incrementi di prestazioni per watt.

Insieme agli ovvi benefici in termini di consumi, HBM occupa qualcosa come il 94% in meno di spazio, visto che è posizionata sul sottostrato del package. Non solo, ciò implica una più piccola griglia di distribuzione elettrica visto che i moduli possono operare a frequenze più basse mantenendo un’elevata banda passante. Questa sembra essere l’unica opzione disponibile per creare componenti ad alte performance dal fattore di forma ridotto.

L’approccio dell’HBM al design dei moduli è relativamente semplice: ogni die DRAM è “impilato” sopra l’altro, con una disposizione a grattacielo laddove finora abbiamo avuto una sorta di implementazione “urbana”. Ciò significa che HBM occupa comunque fisicamente un bel po’ di spazio, ma stavolta viene utilizzata anche la terza dimensione, con il vantaggio poi che ogni stack può essere da 1GB.

Nel caso dell’architettura AMD Fiji, ognuna delle stack ha 4 die DRAM da 256MB ciascuna, e comunicano con la GPU tramite un bus a ben 1024 bit.

Mentre le GDDR5 dovevano affidarsi ad alte frequenze per compensare un’ampiezza bus ridotta, la posizione fisica dell’HBM permette enormi ampiezze bus in quanto il design del controller è più compatto e meno complesso. Dall’altro lato dell’equazione, un bus più ampio permette alle RAM di operare a frequenza minore e con voltaggi minori raggiungendo comunque elevati valori di banda passante.

Temperature inferiori comunque non significano temperature “neutre” per HBM. Trovandosi vicino ad un core già di per sé bollente, ciò significa che si crea una sfida quando bisogna raffreddare tutto ciò. Difatti, mentre la Fury X si affida ad un sistema di raffreddamento AIO, la Fury necessita di un gigantesco dissipatore per contenere le temperature.

In termini numerici di velocità, le HBM di AMD al momento operano a 500 MHz con ogni stack che accede ad un bus largo 1024 bit. Ciò garantisce una banda di 128 GB/s per stack, 512 GB/s per l’intero setup. Tutto ciò è ottenuto a latenze incredibilmente ridotte.

Parlare di bandwidth però, è un conto, ma convincere l’utenza che 4 GB sono buoni quanto 6, 8 o perfino 12 GB di GDDR5 è un’impresa ardua. Se da un lato sono state spese tantissime risorse sulla creazione di questo tipo di memorie, dall’altro i giochi odierni utilizzano un gigantesco ammontare di memoria quando vengono eseguiti in 4K o risoluzioni superiori. Ciò rallenterà il diffondersi delle memorie HBM? AMD crede di no, in quanto ha istituito differenti algoritmi di allocazione risorse tramite i loro driver per assicurare che ogni modulo venga utilizzato e che il caching on-chip sia operativo costantemente, in modo tale da riempire e svuotare i 4GB di memoria più velocemente. Tutto ciò, in teoria, ovviamente.

L’architettura nei dettagli: AMD PowerTune–>

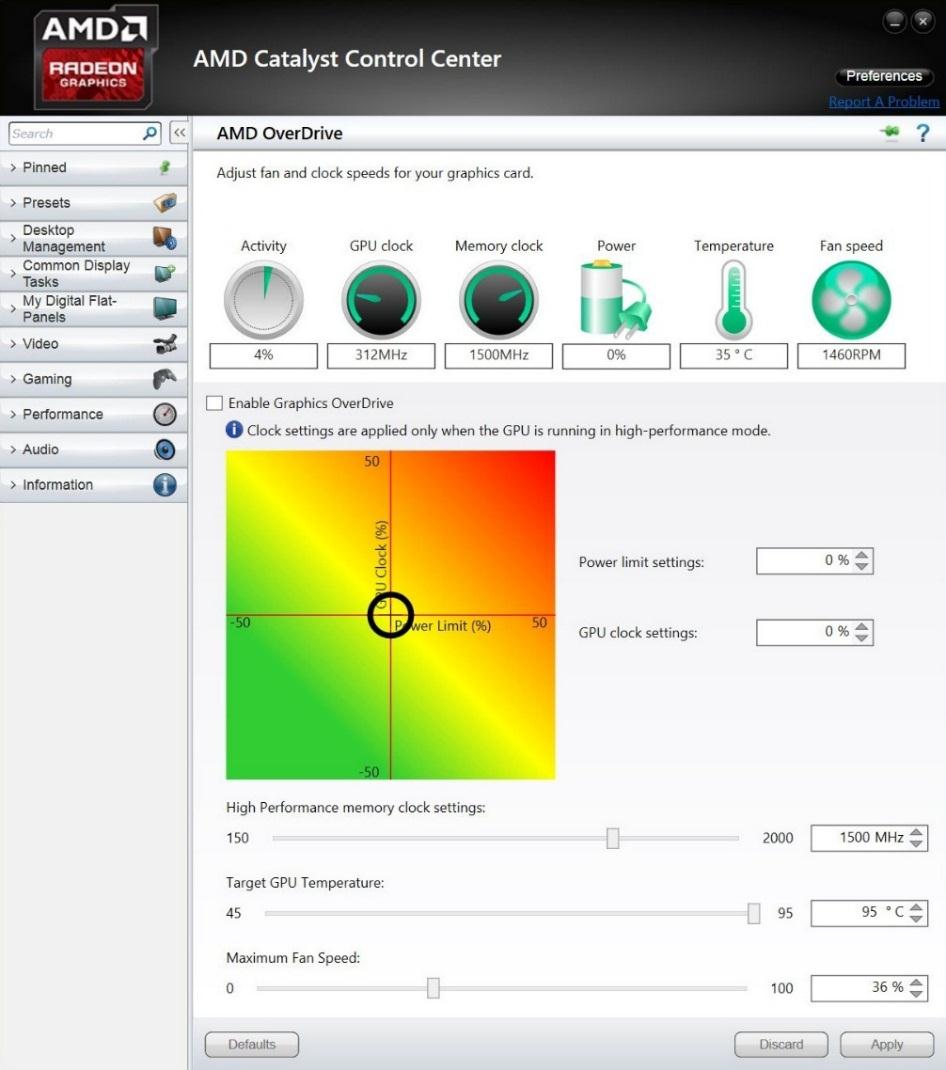

La tecnologia PowerTune è una feature esclusiva che ottimizza le prestazioni della GPU seguendo una serie di condizioni modificando dinamicamente frequenze, voltaggi e velocità delle ventole, fornendo le migliori performance possibili per un dato limite termico o di potenza assorbita. La nuova schermata AMD Overdrive nell’interfaccia utente del Catalyst Control Center offre ancora più flessibilità per gestire il comportamento della GPU. L’overclock non è più inteso nei termini di un valore assoluto di frequenza (ad esempio 1000 MHz). Invece, l’utente ha controllo su più parametri per aumentare le performance. AMD OverDrive include un controllo per le frequenze GPU che aumenta i clock medi di una certa percentuale, mantenendo al contempo i parametri stabiliti per potenza, temperature e velocità ventola.

L’architettura nei dettagli: Frame Rate Targeting Control–>

Seguendo il discorso dell’assorbimento di corrente e dell’efficienza, il Frame Rate Targeting Control è una nuova feature che viene introdotta con la serie 300 di schede grafiche AMD, permettendo agli utenti di impostare il massimo framerate di una determinata applicazione in full screen; i benefici che l’FRTC sono i ridotti consumi per la GPU (ottimo quando i giochi vanno a più FPS della frequenza di aggiornamento dello schermo) e la riduzione del calore e del rumore generati dalla scheda. Di seguito uno screenshot della feature nel Catalyst Control Center:

L’architettura nei dettagli: Virtual Super Resolution–>

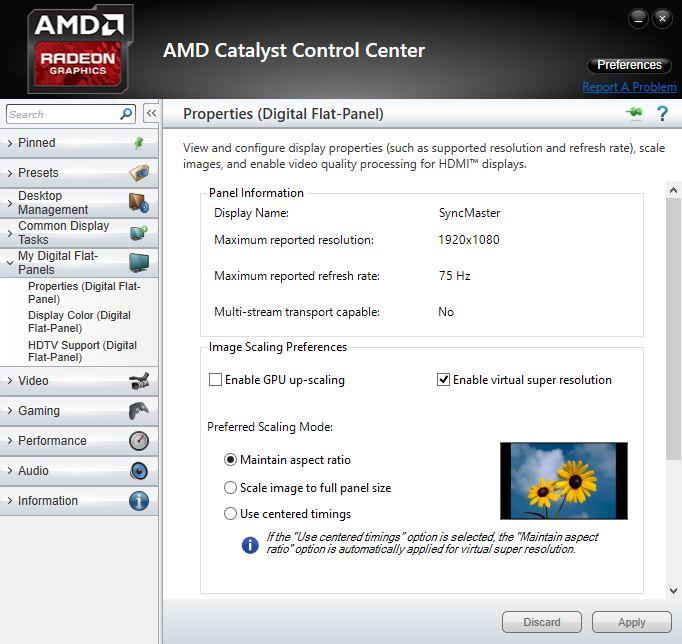

Il Super Sampling Anti-Aliasing (SSAA) è uno dei metodi di anti-aliasing che creano texture più uniformi e meno problemi poligonali, ma non è supportato da tutti i giochi o motori grafici. La VSR è una feature agnostica nei confronti di giochi e motori grafici, ed è una feature che consente di simulare l’SSAA in qualsiasi gioco. La VSR può essere utilizzata in congiunzione con l’AA nativo, per una granularità ancora maggiore nei settaggi grafici. La VSR permette di renderizzare ad una risoluzione maggiore (fino a 4K) e downscalare alla risoluzione nativa dello schermo. Utilizzandola, si può avere la qualità di uno schermo 4K su un monitor 1080p:

Una volta abilitata la feature, si può aumentare la risoluzione sia ingame che sul desktop. Qui, lo screenshot delle impostazioni di Windows su di uno schermo Full HD ma con VSR attivata:

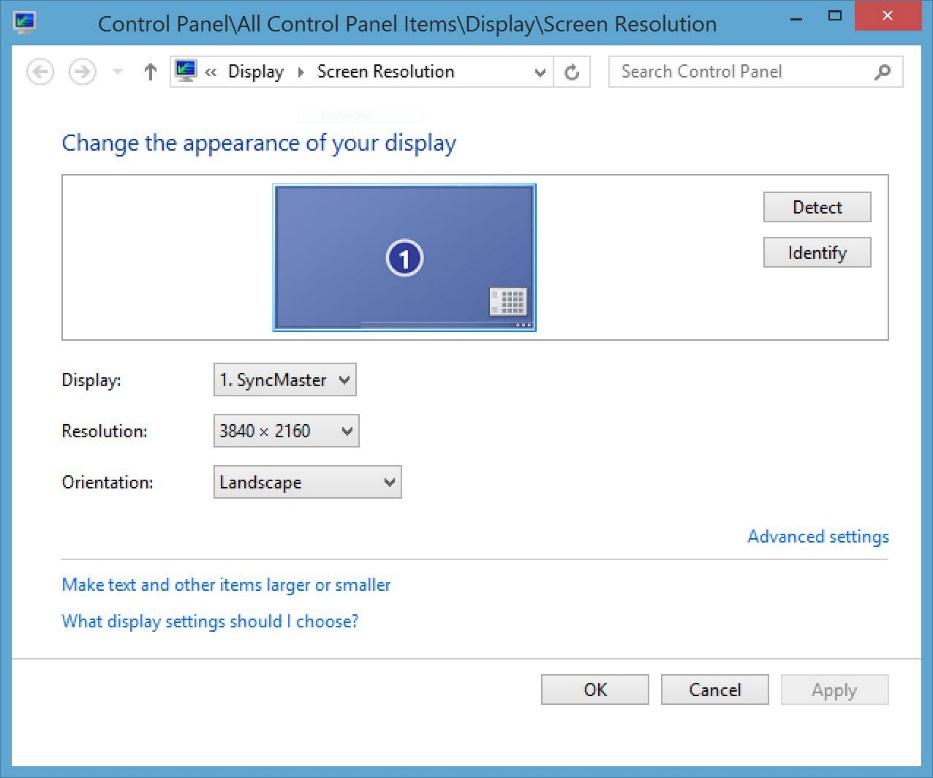

Una delle caratteristiche più interessanti di questa tecnologia è che l’impatto prestazionale è pari al carico di lavoro generato da un’immagine generata su di uno schermo 4K. Nulla è perduto sul fronte dello scaling delle immagini, ottenendo lo stesso numero di FPS che si otterrebbero in 4K con un livello qualitativo quasi pari:

L’architettura nei dettagli: DX12–>

Le DirectX 12 sono nuove API grafiche di Microsoft simili a quelle utilizzate dalla console, che permette agli sviluppatori di giochi un maggiore e miglior accesso alle risorse hardware. Questo controllo diretto o “esplicito” migliora la resa prestazionale delle CPU AMD FX, delle APU e delle AMD Radeon. In soldoni: hardware più efficiente grazie a software più intelligente. A discrezione dello sviluppatore di giochi, questa efficienza superiore può essere utilizzata per un maggior framerate, per minore latenza (contesto ideale per la VR), minori consumi, miglior qualità dell’immagine o una combinazione bilanciata di queste 4 direzioni. In ogni scenario, i videogiocatori beneficieranno della scelta di hardware AMD per giocare a titoli compilati in DX12. La serie AMD Radeon 300 supporta pienamente le DirectX 12, con miglioramenti rispetto ai prodotti precedenti grazie a:

- Tassellazione più veloce

- Tiled Resources (il supporto a enormi texture virtuali, abilitando il caricamento dinamico di porzioni di esse nella VRAM per dettagli sempre al massimo della qualità)

Shaders asincroni

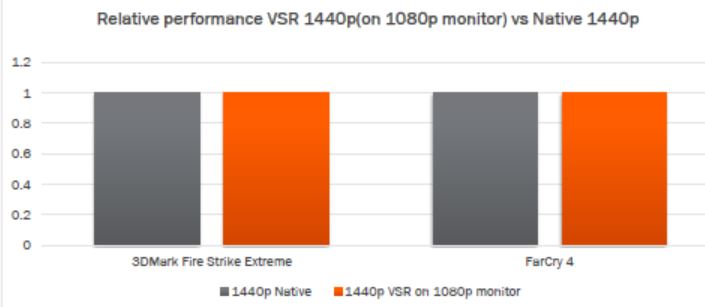

Gli shaders asincroni sono una nuova feature delle DX12 che permettono a complicate operazioni di calcolo grafico di utilizzare tutte le risorse disponibili sulle GPU AMD Radeon. Spezzare un calcolo più grande in più parti piccole e processarle parallelamente aumenta enormemente l’efficienza e le prestazioni; AMD, con la sua architettura Graphics Core Next, ha una porzione hardware dedicata a tale compito, l’Asynchronous Compute Engine, capace di svolgere tale operazione ad una velocità davvero elevata.

Ecco una semplice illustrazione di come questo processo avveniva prima di questa tecnologia:

Con l’utilizzo degli ASYNC Shaders invece:

Il risultato consiste in un più veloce processing di ogni frame, ottimizzando i tempi e aumentando il framerate sensibilmente.

Multi-GPU con le DX12

Le versioni precedenti delle DirectX non supportavano direttamente le configurazioni multi-GPU. Gli sviluppatori hanno progettato il loro supporto personalizzato nei giochi e nei drivers, ma spesso con limitazioni: minimo controllo sull’hardware, combinazioni di GPU ristrette e difficoltà nell’ottimizzare il carico di lavoro su più GPU. Il multiadapter esplicito delle DirectX 12 aggiunge il supporto al multi-GPU per la prima volta, permettendo agli sviluppatori di giochi un livello di controllo diretto dell’hardware PC. In questo modo, i motori grafici potranno tirar fuori prestazioni maggiori dai sistemi multi-GPU, utilizzando configurazioni semplicemente irrealizzabili in DirectX 11, come ad esempio la coesistenza di GPU di brand diversi.

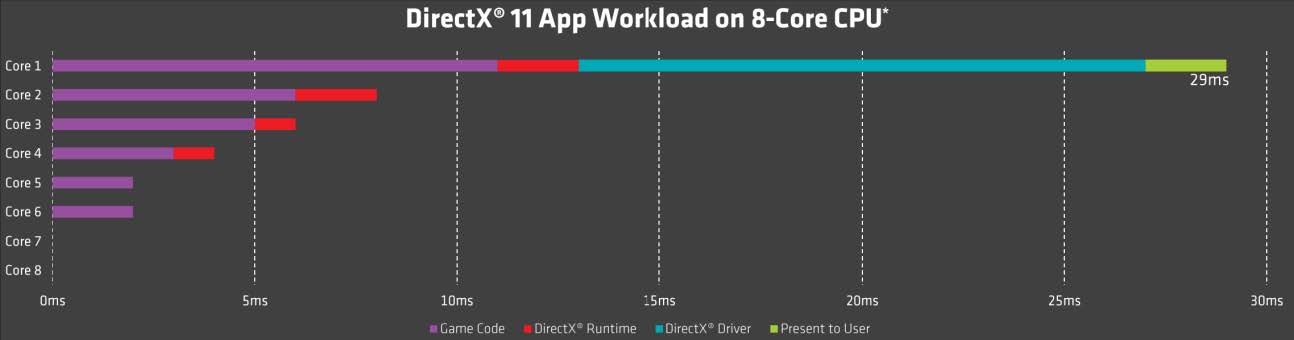

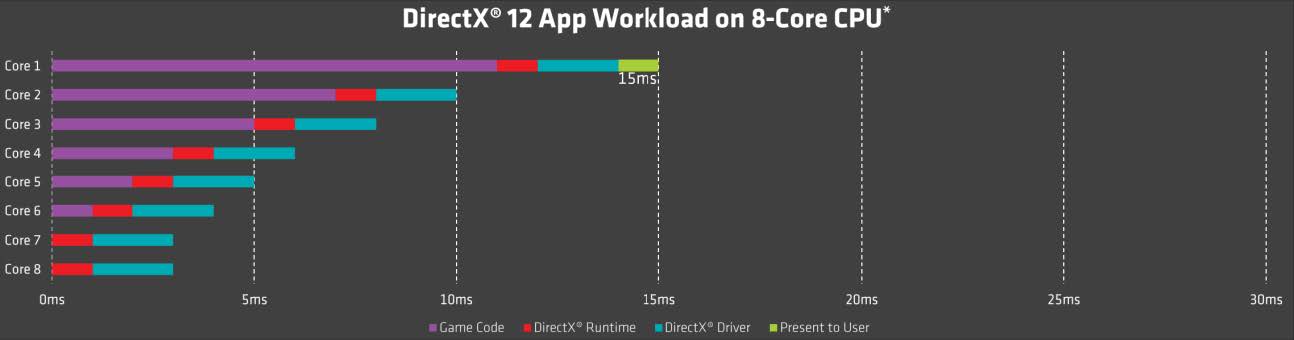

Efficienza con CPU multi-core

Le versioni precedenti delle DirectX non erano capaci di utilizzare appieno una CPU multi-core come i processori AMD FX a 8 core. Gran parte del lavoro delle API grafiche in un PC finiscono per sovraccaricare uno o due core della CPU, peggiorando le performance drasticamente. Con le DirectX 12, invece, il carico di lavoro di un motore grafico può essere suddiviso su tutti e 8 i core, portando ad un’uniformità nel tempo di esecuzione di una serie di calcoli.

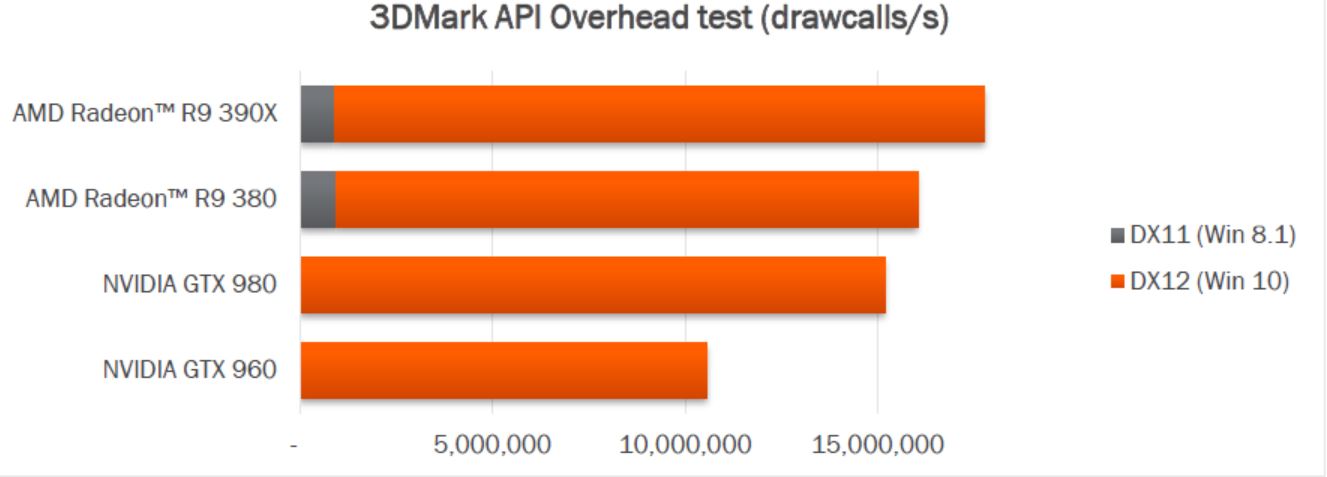

3DMark® API Overhead feature test

Il test Overhead API del 3DMark’s API è utilizzato per misurare l’efficienza di un API su una determinata scheda grafica. Con le DirectX 12 (su Windows 10) AMD ha visto un drastico incremento nel numero di chiamate draw al secondo paragonato ai competitors e ai risultati in DirectX 11 (su Windows 8.1):

L’architettura nei dettagli: FreeSync–>

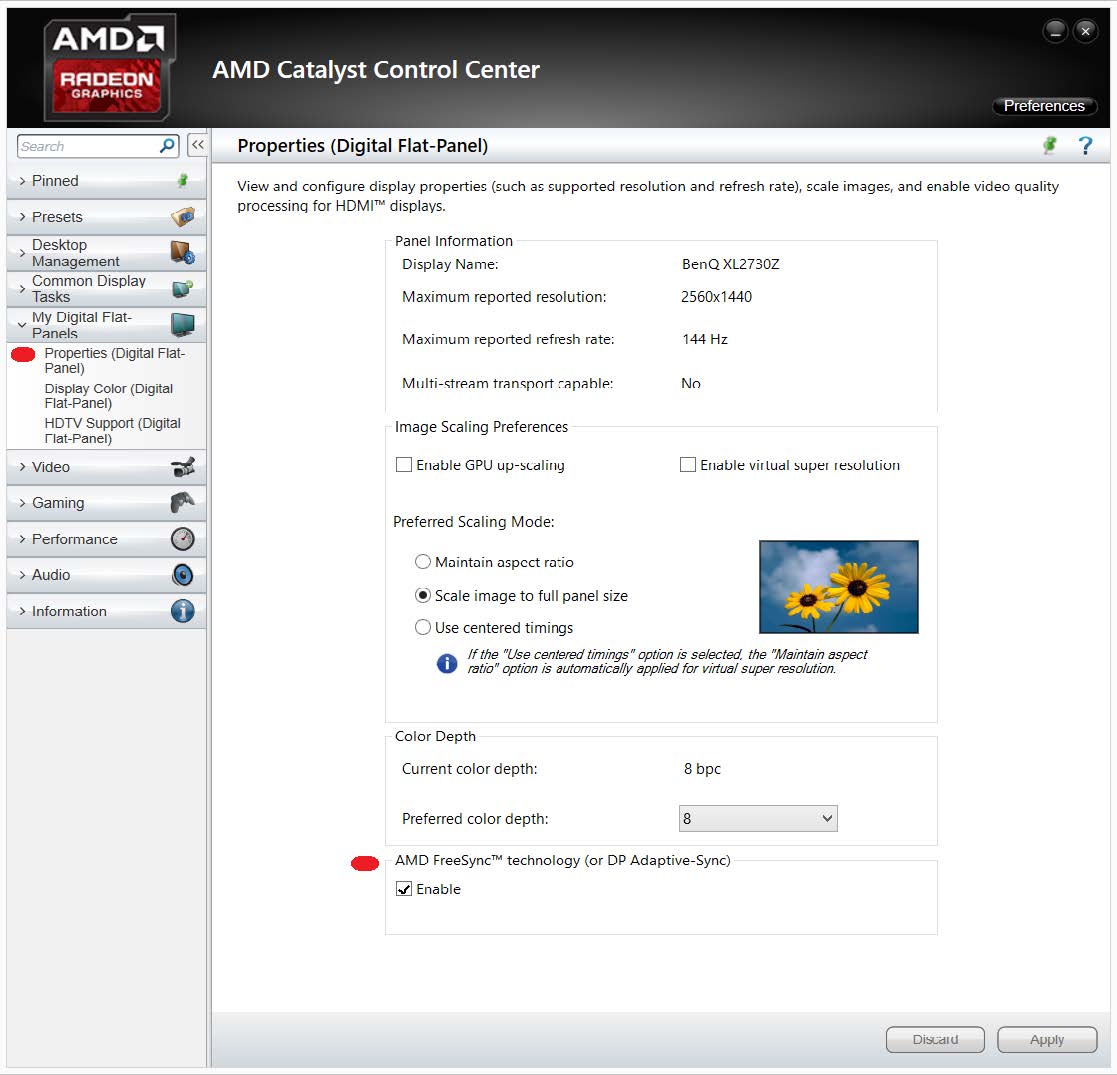

La tecnologia AMD FreeSync sincronizza, su determinate APU e GPU AMD, il refresh rate di un monitor con l’output della scheda grafica, eliminando il fastidioso fenomeno del tearing e dello stuttering-

Per abilitare l’AMD FreeSync, basta connettersi ad un monitor compatibile con la tecnologia AMD FreeSync, abilitandola poi nel pannello Catalyst Control Center.

Inoltre, non c’è paragone con la soluzione adottata da NVIDIA, il G-Sync:

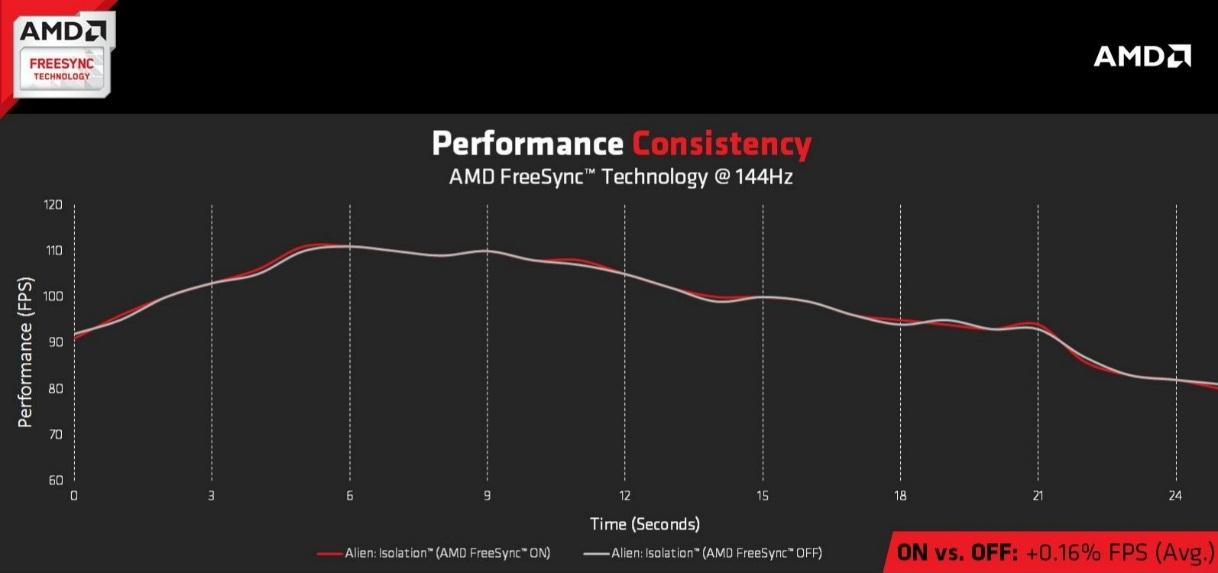

Un’altra questione importante sul FreeSync è che è free. Non c’è impatto prestazionale utilizzandolo, e gli FPS dei giochi rimane lo stesso di prima. Qui è mostrata una run di Alien Isolation con e senza FreeSync:

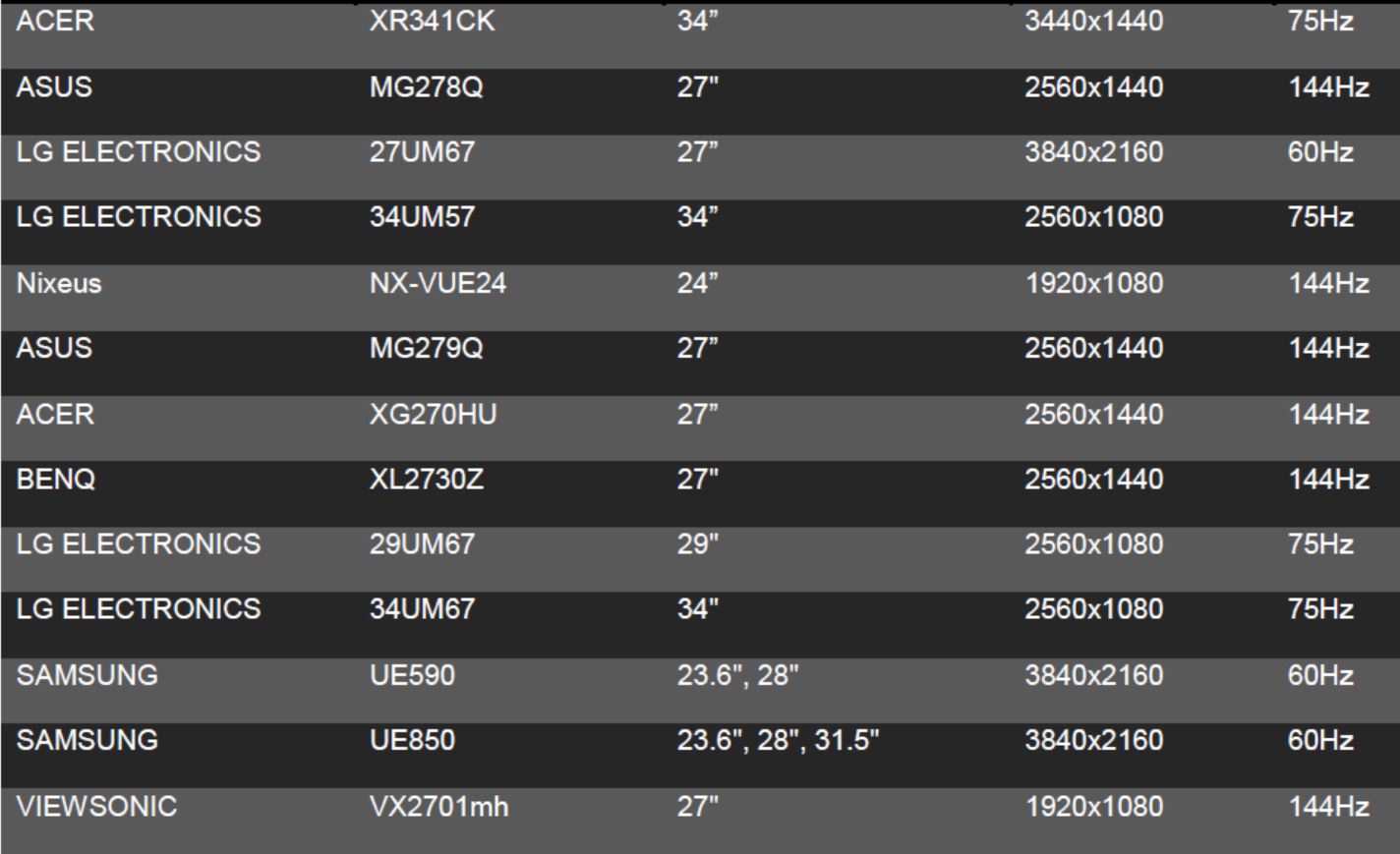

Ecco una lista dei monitor attualmente compatibili con la tecnologia FreeSync:

AMD FreeSync è una tecnologia free: libera da costi aggiuntivi per hardware, libera da penalità prestazionali, libera come standard, aperta a chiunque voglia utilizzarla nel mondo del gaming, con un feeling che difficilmente vi farà tornare indietro.

Configurazione di prova e metodologia di test–>

La configurazione utilizzata per i test è la seguente:

| CPU | Intel Core i7 5960x |

|---|---|

| Heatsink | AlphaCool NexXxos Cool Answer 360 D5/XT |

| Mainboard | ASUS ROG Rampage V Extreme |

| RAM | Corsair Dominator Platinum DDR4 16 GB 2666 MHz |

| VGA | Sapphire Radeon R9 Fury Tri-X OC 4GB HBM |

| Sound Card | Creative SoundBlaster Omni 5.1 e Creative T30 Wireless Speakers |

| HDD/SSD | Corsair Neutron XT SSD 480 GB |

| PSU | Corsair AX1500i Digital PSU |

| Case | Corsair Graphite 780T Arctic White |

| Monitor | Acer CB280HK 4K Display |

| Keyboard | Corsair Gaming STRAFE |

| Mouse | Corsair Gaming Sabre RGB Laser |

| OS | Windows 10 Pro x64 |

Ecco la suite di benchmark (e giochi) con cui testeremo la scheda video:

- Unigine Heaven Benchmark 4.0

- Futuremark 3DMark Fire Strike

- Futuremark 3DMark Fire Strike Extreme

- Futuremark 3DMark Fire Strike Ultra

- Thief (2014) (Benchmark integrato)

- Bioshock Infinite (Benchmark integrato)

- Metro Last Light (Benchmark integrato)

- Terra di mezzo: Ombra di Mordor (Benchmark integrato)

Dove disponibile la scelta della risoluzione, i test sono stati eseguiti ai seguenti valori. Laddove si trattasse di un benchmark, le modalità predefinite sono state utilizzate:

- 1680×1050, AA x2 (WSXGA+)

- 1920×1080, AA x4 (Full HD)

- 2560×1440, no AA (2K, QWHD)

- 3840×2160, no AA (4K, UHD)

Qui di seguito le VGA testate con la nuova piattaforma:

- Sapphire AMD Radeon R7 250X Vapor-X OC 1GB (Cape Verde XT, 1100/1300) – Recensione

- Sapphire AMD Radeon R9 290X Tri-X OC 8GB (Hawaii XT, 1020/1375) – Recensione

- Sapphire AMD Radeon R9 290X Tri-X Vapor-X 4GB (Hawaii XT, 1080/1410) – Recensione

- Sapphire AMD Radeon R9 290X Tri-X Vapor-X 8GB (Hawaii XT, 1030/1375) – Recensione

- Sapphire AMD Radeon R9 290X Tri-X Vapor-X 4GB (CrossFireX) (Hawaii XT, 1080/1410, 2 GPU) – Recensione

- Sapphire AMD Radeon R9 290X Tri-X Vapor-X 4GB (CrossFireX) (Hawaii XT, 1080/1410, 3 GPU) – Recensione

- Sapphire AMD Radeon R9 380 Nitro 4GB (Tonga, 985/1450) – Recensione

- Sapphire AMD Radeon R9 390X Tri-X 8GB (Grenada XT, 1055/1525) – Recensione

- Sapphire Radeon R9 Fury Tri-X OC 4GB HBM (Fiji, 1040/1000) – Recensione

- MSI NVIDIA GeForce GTX960 Twin Frozr V Gaming 2GB (Maxwell GM-206-300, 1241/1753) – Recensione

- MSI NVIDIA GeForce GTX970 Twin Frozr V Gaming 4GB (Maxwell GM-204-200, 1140/1753) – Recensione

- ASUS NVIDIA GeForce GTX980 Strix OC 4GB (Maxwell GM-204-400, 1178/1753) – Recensione

- NVIDIA GeForce GTX980 4GB (reference) (Maxwell GM204-400, 1127/1753) – Recensione

Test sintetici: Unigine Heaven–>

Heaven, prodotto da Unigine è stato il primo Benchmark DX11. Lo scopo principale è quello di mettere in risalto gli straordinari effetti della Tessellation. Difatti dai semplici modelli osservabili con tessellation disattivata, si arriva ad oggetti ricchi di profondità e sporgenze senza dover creare trame complesse. Il compito di arricchire il modello è lasciato all’unità tessellatrice, per cui si tratta di uno strumento indispensabile per valutare l’efficienza dei questa unità nelle moderne soluzioni DX11:

Test sintetici: FutureMark 3DMark–>

In concomitanza con il lancio di Windows 8, Futuremark ha lanciato il nuovo 3DMark, chiamato appunto 3DMark, senza alcun numero riconoscitivo, a segnare la forte integrazione che ha con qualsiasi sistema, da Android a Windows a iOS a OSX, dando per la prima volta la possibilità di paragonare le prestazioni su smartphone e PC fisso in maniera schematizzata e professionale. Il benchmark dispone di svariati test, di cui utilizziamo i più intensivi per mettere alla prova le schede video. Tra questi, il più impegnativo è il Fire Strike, che spinge la tessellazione a livelli davvero elevati, e che “vanta” due versioni ancora più spinte: Extreme (con scene pre-renderizzate a 2560×1440) ed Ultra (scene pre-renderizzate a 3840×2160, ovvero 4K).

Test sui giochi: Bioshock Infinite–>

Continuiamo con Bioshock Infinite, che ci mette nei panni di Booker DeWitt, un investigatore privato, un tempo agente Pinkerton, incaricato di ritrovare una ragazza, Elizabeth, tenuta prigioniera a Columbia, una fantomatica città sospesa nei cieli, dove le modifiche genetiche sono considerate veri e propri beni di lusso. Per la prima volta nella serie di Bioshock, il personaggio ha un volto, un nome ed una storia precedente al gioco, che verrà svelata con l’avanzare della partita. Il gioco supporta le API DirectX 11, con le quali supporta tecnologie quali: High Definition Ambient Occlusion, Contact Hardening Shadows e Diffusion Depth of Field. È implementato inoltre il supporto all’FXAA (anti-aliasing ad approssimazione rapida) ottimizzato per l’utilizzo su SM 5.0. Il gioco è ottimizzato per architetture AMD, in quanto parte del programma AMD Gaming Evolved.

Test sui giochi: Metro Last Light–>

Dopo l’incredibile successo di Metro 2033, ecco che fa capolino sugli schermi dei nostri PC il suo successore, Metro Last Light, basato sul romanzo Metro 2034 di Dmitry Glukhovsky, che vede il mondo alle prese con i postumi di una terza guerra mondiale atomica, con tutto ciò che ne consegue: la popolazione ancora in vita in Russia si è trasferita nella famigerata metropolitana russa, dotata di 298 km di binari e tunnel sotto Mosca. Ancora una volta, il giocatore rivestirà i panni di Artyom, per impedire una guerra civile che potrebbe portare alla fine il genere umano. Tecnicamente parlando, il gioco è incredibilmente pesante, sia per poligoni a schermo che per requisiti, facendo uso di tutte le tecnologie introdotte dalle DirectX11: Depth of Field, HDAO, Tessellation e real-time Motion Blur. Il gioco è ottimizzato per schede video NVIDIA, dato il supporto all’NVIDIA PhysX e in quanto parte del programma NVIDIA – The Way It’s Meant To Be Played.

Test sui giochi: Middle Earth: Shadow of Mordor–>

Chi è appassionato della saga di J.R.R. Tolkien sa che, fino a Settembre 2014, non esisteva un gioco degno di tal nome che narrasse le vicende della Terra di mezzo. Grazie a Monolith e ai Warner Studios, però, ora la collana fantasy più famosa del globo terracqueo vanta un gioco tripla A, forte di una trama travolgente, una grafica sul filo del fotorealismo ed un sistema di combattimento che sembra l’evoluzione del Free Form Fighting System visto in Prince of Persia: Spirito Guerriero. Il risultato? Un titolo must-have, il cui motore grafico si rifa a quello utilizzato da Batman: Arkham Origins, titolo che sostituisce nella nostra suite di benchmarks. Il gioco è ottimizzato per schede video NVIDIA, dato il supporto all’HBAO, all’SMAA e più in generale a tutti i GameWorks dell’azienda. Il gioco, soprattutto alle alte risoluzioni e con i filtri al massimo, richiede un quantitativo di memoria video non indifferente, e pertanto risulta pienamente indicato qualora voleste mettere alla prova schede video con un quantitativo VRAM maggiore:

Considerazioni finali–>

[conclusione]

[titolo]Design e qualità costruttiva[/titolo]

PCB nuovo, design del dissipatore nuovo, GPU nuova, memorie nuove. Tanta, tanta carne al fuoco per questa scheda video che al tatto e nel design presenta solidità e sobrietà, anche se i tribali stilizzati degli stickers danno quel tocco in più rispetto alla versione del dissipatore Tri-X visto sulla R9 390X recensita alcuni giorni addietro. La qualità costruttiva è ottima, e la scheda, nonostante le dimensioni generose del dissipatore, non vede alcuna curvatura nel PCB una volta montata. Quest’ultimo, rappresenta in realtà solo poco più della metà della scheda, grazie alle innovazioni sul fronte delle memorie di cui abbiamo parlato qualche pagina fa.

[voto=”10″]

[/conclusione]

[conclusione]

[titolo]Prestazioni e overclock[/titolo]

Ok, finalmente giungiamo al resoconto che forse tutti aspettavate (e aspettavamo): la Fury è veloce. Quanto? Circa il 30% più veloce di una 390X, quasi sempre. In pochi titoli (quelli mossi dagli NVIDIA GameWorks) il divario si riduce, ma si tratta pur sempre di parecchi FPS in più. La GTX980, di cui la scheda punta essere il public enemy #1, viene bruciata in ogni gioco testato, il che è normale considerando che si tratta di una scheda superiore sia sulla carta che nel prezzo. L’overclock? Ci ha deluso. La scheda non era stabile nemmeno a pochi MHz in più, e la colpa è da imputare, forse, nella scelta di rimanere fedeli al PCB reference della stessa Fury X. Poco male, la scheda è già prestante, anche se raggiungere i livelli della Fury X con un po’ di overclock non ci sarebbe dispiaciuto.

[voto=”8″]

[/conclusione]

[conclusione]

[titolo]Compatibilità e consumi[/titolo]

La scheda è dotata di connettore PCI-E 3.0 16x, ed è compatibile anche con la Gen2 dello standard. Non abbiamo notizie riguardo alla compatibilità con la Gen1 dello standard, ma considerando che si tratta di un bus utilizzato su configurazioni di ben 10 anni fa, la cosa non ci interessa più di tanto. Il TDP (che per AMD è il consumo tipico) è di 250W circa, ma la scheda ha connettori PCI-E che consentono di assorbire fino a 375W. Probabilmente, si tratta di predisposizioni volte a stabilizzare le tensioni in entrata (affidate adesso ad una sezione di alimentazione più piccola) o per coloro che vogliono modificare la scheda con softmod o hardmod. Alimentatore minimo consigliato? 500W, e aggiungete 250W per ogni scheda che volete installare in parallelo.

[voto=”9″]

[/conclusione]

[conclusione]

[titolo]Prezzo[/titolo]

La Sapphire Radeon R9 Fury Tri-X OC 4GB HBM costa 533€ su Amazon.it, presentando un prezzo davvero appetibile qualora abbiate bisogno di una scheda per giocare al massimo dei dettagli in 2K o con quasi tutto al massimo in 4K, rinunciando però a qualche filtro extra. La scheda, che si posiziona come concorrente della GTX980, costa circa 50€ più di quest’ultima, presentando però un livello prestazionale superiore. Vi invitiamo ad acquistare presso i rivenditori ufficiali Sapphire, in quanto pur presentando un prezzo superiore ai VAT Player (coloro che evadono l’iva tramite meccanismi al limite della legalità), forniscono supporto post-vendita/RMA, cosa che suddetti rivenditori non ufficiali non garantiscono.

[voto=”9″]

[/conclusione]

Una scheda veloce, e tanto, con un prezzo adeguato a ciò che offre e un design davvero interessante, per non parlare delle soluzioni tecnologiche adottate. Peccato per l’overclock, che sul nostro sample non ha mostrato cambiamenti sostanziali nelle performance. Il voto? La Sapphire R9 Fury si aggiudica il nostro Hardware Platinum Award:

Per oggi è tutto da ReHWolution, non dimenticate di seguirci sui nostri social network:

La recensione

Sapphire Radeon R9 Fury Tri-X OC 4GB HBM

Una scheda veloce, mossa da una GPU tutta nuova e che porta competitività da parte di AMD nei confronti di NVIDIA. La Sapphire R9 Fury Tri-X è una gran bella scheda che riesce a muovere fluidamente qualsiasi gioco le si dia in pasto.

Pro

- Scheda veloce

- Efficienza energetica di gran lunga superiore alle precedenti schede grafiche AMD

- Più veloce della GTX980 a pochi euro in più

Contro

- Overclock di poco conto sul nostro sample

Sapphire Radeon R9 Fury Tri-X OC 4GB HBM Prezzi

Raccogliamo informazioni da vari negozi per indicare il prezzo migliore

Discussione su post