Introduzione: AMD e Polaris 10: la RX 480–>

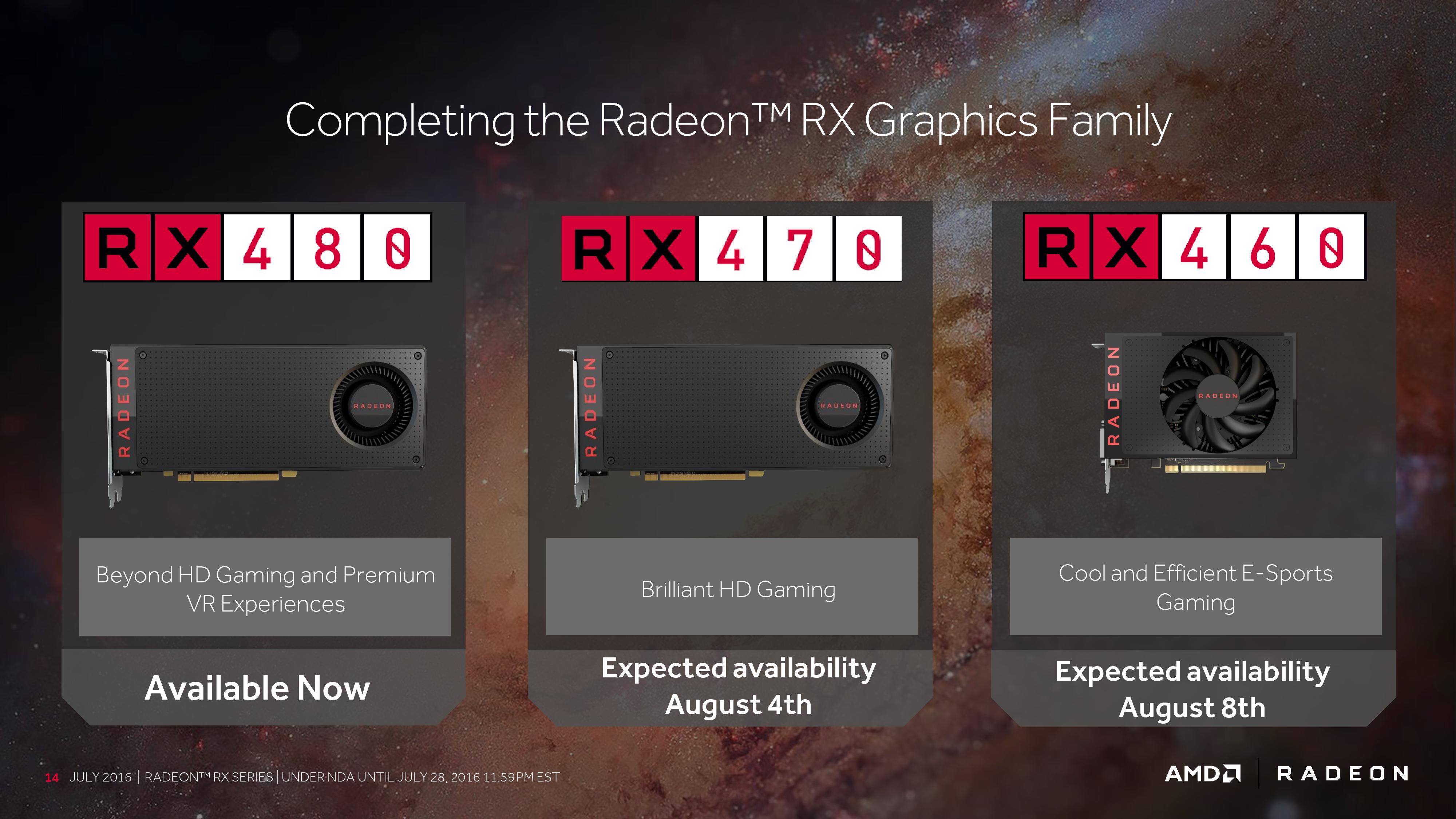

Ci siamo, finalmente. Dopo un po’ di attesa (e qualche ritardo da parte nostra), siamo pronti a parlarvi delle nuove GPU di AMD, nome in codice Polaris. La lineup, composta da 2 GPU e 3 schede video, per il momento, la AMD Radeon RX 480, la AMD Radeon RX470 e la AMD Radeon RX460.

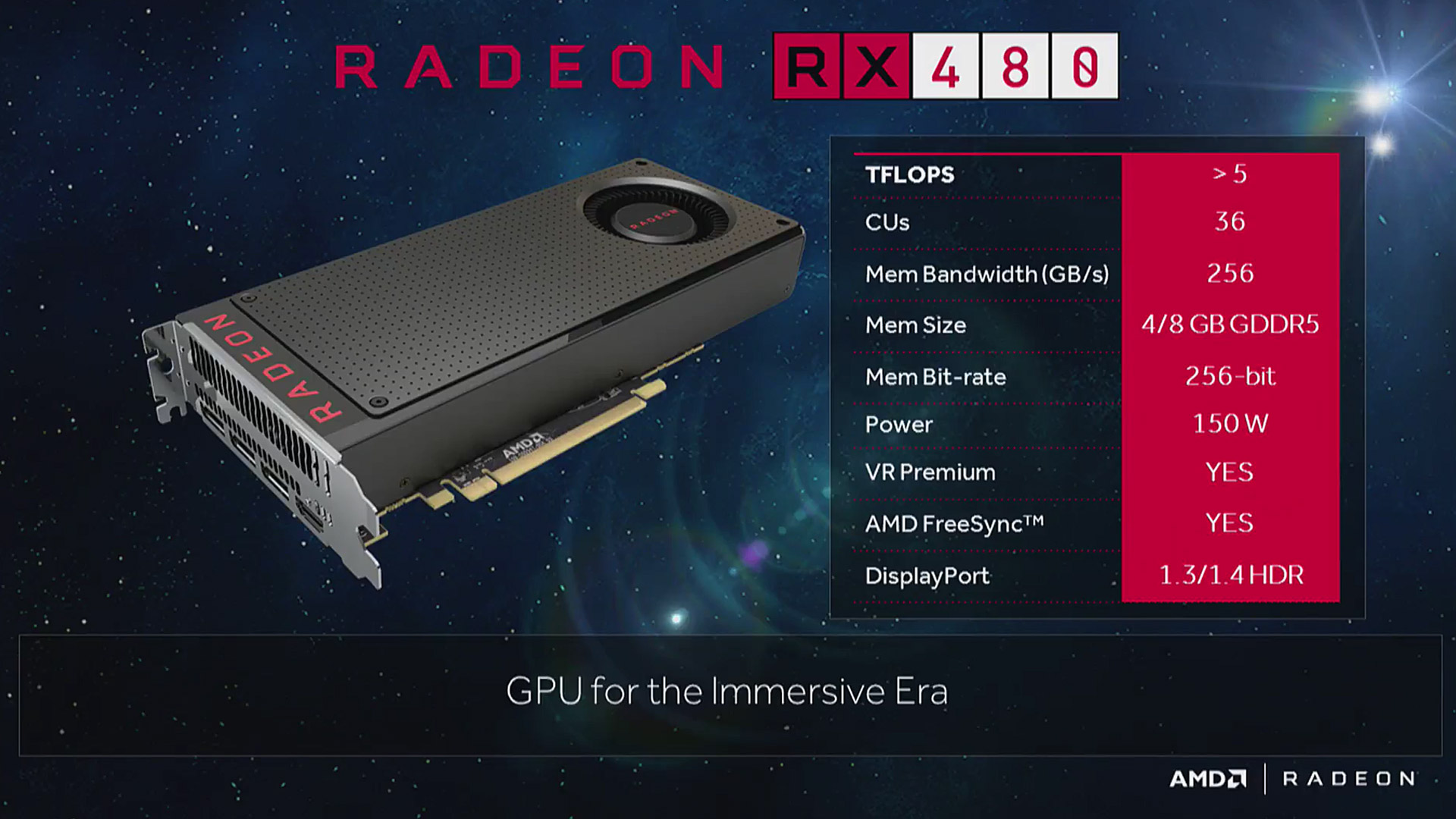

Ovviamente, cominciamo con la “capolista”, parlandovi della AMD Radeon RX480, basata su GPU AMD Polaris 10 “Ellesmere XT”, ovvero dotata del massimo numero di CU (Compute Units), per un totale di 2304 Shaders, abbinati ad un bus da 256 bit verso 4 o 8 GB di memoria GDDR5 da 7/8 Gbps.

Anticipandovi che nei prossimi giorni vedrete le nostra review delle RX470 e 460, intanto vi lasciamo alla nostra recensione (corredata dell’analisi completa dell’architettura di 4° generazione di AMD) della AMD Radeon RX 480. Buona lettura!

AMD Radeon RX480: specifiche tecniche–>

Di seguito, le specifiche tecniche della scheda grafica di AMD. Ulteriori informazioni sono consultabili sul sito ufficiale (AMD):

Con una potenza superiore ai 5 TFLOPS (per la precisione, 5.83 TFLOPS), la RX 480 è equipaggiata con 36 CU, ognuna con 64 Stream Processors, per un totale di 2304 shaders operanti ad un base clock di 1120 MHz, con un boost clock di 1266 MHz.

Disponibile nelle varianti da 4GB e da 8GB, la scheda dispone di memoria GDDR5 clockata rispettivamente a 7000 MHz e 8000 MHz a seconda del taglio di memoria acquistato, e il bus con cui la GPU comunica con le memorie è a 256 bit.

La GPU utilizzata è la Polaris 10, nella sua configurazione completa a 36 CU, disponibile anche nella variante a 32 CU che fa da unità di calcolo della RX 470, che oggi vede l’uscita nel mercato.

AMD fin da subito ha parlato della RX 480 come di una scheda economica, con consumi ridotti e dalle performance adeguate a giocare in modo adeguato in VR (Virtual Reality), garantendo un’esperienza molto fluida in Full HD e gaming in 2K ad un framerate più che decente, obiettivo che, come vedrete dai benchmark, ha centrato in pieno.

Il consumo massimo è di circa 150 W, e al momento del lancio della scheda, avvenuto circa un mese fa, ci sono stati dei problemi che ne avrebbero teoricamente pregiudicato l’operabilità in “sicurezza” su schede madri particolarmente vecchie, per via dell’eccessivo assorbimento di corrente tramite il connettore PCI-E.

Chiariamo, intanto, che il pericolo non è mai stato così concreto come alcune altre testate hanno lasciato credere (e che la totalità dei “report” di utenti che hanno bruciato le proprie mainboard utilizzavano in realtà vecchie schede madri e svariate RX 480 utilizzate per il mining).

Con la seconda release di driver (i 16.7.1) AMD ha risolto la distribuzione di potenza, aumentando il carico sul connettore di alimentazione PEG e diminuendolo sul socket PCI-e 16X, rendendo completamente sicuro l’utilizzo di una (fino a 4) schede su qualsiasi scheda madre.

150W, in relazione al consumo della GTX 1060 (diretta concorrente, sebbene quest’ultima costi di più), possono sembrare tanti, ma considerando che veniamo da svariate generazioni di schede grafice AMD con un consumo energetico superiore ai 230-250W, tale aumento dell’efficienza non può che giovare alla reputazione di AMD, da sempre etichettata come manufacturer di schede affamate di corrente e termicamente inadeguate ai tempi.

La scheda reference presenta il supporto a tutte le tecnologie AMD, una fra tutte il FreeSync, con connessioni HDMI 2.0b e DisplayPort 1.3, con il supporto alla bozza di specifiche dello standard in versione 1.4, che però non è ancora stato finalizzato. Non è presente, invece, alcun connettore DVI, rendendo impossibile l’utilizzo della scheda (almeno out-of-the-box) con schermi da 144 Hz, problema risolvibile con l’acquisto di adattatori HDMI to DVI.

L’architettura di Polaris: molto più di GCN 4.0–>

È stato detto molto riguardo l’architettura Polaris di AMD e di come evolva nella nuova generazione di GPU, ma non interpretate male: la cosiddetta “quarta generazione” non cambia nessuno dei principi fondamentali di GCN (Graphics Core Next), aggiornando semplicemente alcuni elementi per aumentare le prestazioni con carichi di lavoro in DX11, DX12, OpenGL e Vulkan.

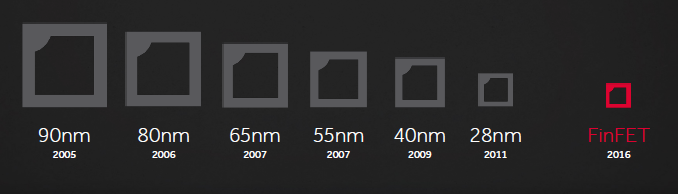

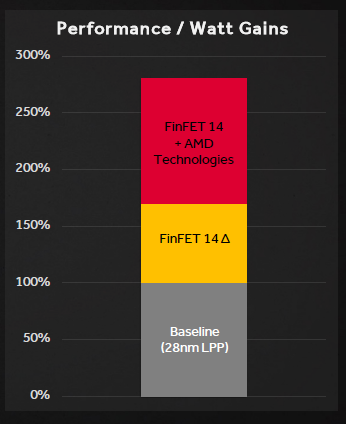

Ancora più importante, è l’incredibile passo in avanti fatto in termini di efficienza, parzialmente ottenuto grazie al nuovo processo produttivo di Samsung FinFET a 14 nm.

Uno dei motivi principali per cui stiamo assistendo ad un balzo in efficienza con queste nuove generazioni di GPU (sia di AMD che di NVIDIA) è il passaggio a nuovi processi produttivi (14 nm per AMD, 16 nm per NVIDIA).

Mentre fino a qualche anno fa era possibile assistere ad una riduzione della grandezza dei transistors su base annua, nel 2011 il fenomeno ha raggiunto uno stop improvviso. All’epoca, fu introdotto il processo produttivo a 28 nm ma a causa di alcuni ostacoli incontrati da entrambe le parti, è stato difficile ottenere progressi tecnologici, per la maggior parte a causa dell’enorme volume di vendite degli smartphone, sottraendo risorse e tempo al mercato.

Sebbene sia nato come processo produttivo particolarmente inefficiente, con una densità di transistors elevata rispetto ai precedenti 40 nm (2009), le ultime incarnazioni (Maxwell per NVIDIA, Granada e Fiji per AMD) sono risultate particolarmente power-efficient, grazie al lavoro degli ingegneri che hanno saputo ottimizzare la potenza in rapporto alla superficie, diminuendo allo stesso tempo la produzione di calore.

I 14 nm, d’altro canto, rappresentano un enorme salto di qualità per AMD, che è adesso capace di sfruttare le lezioni imparate con l’architettura a 28 nm, migliorandola per il nuovo “nodo”.

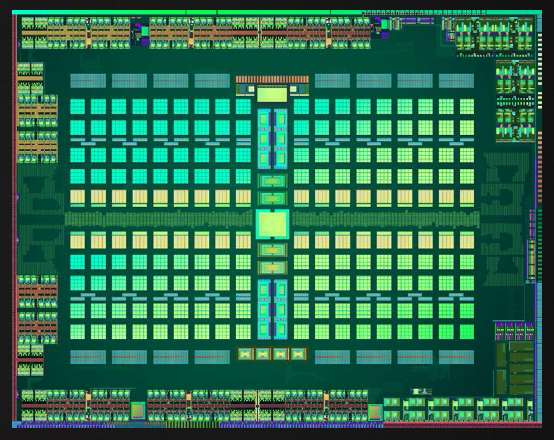

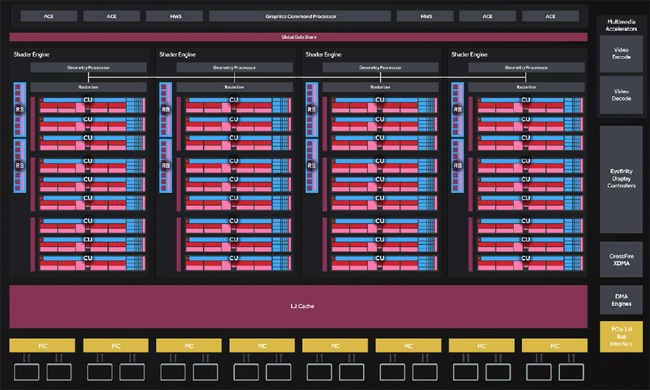

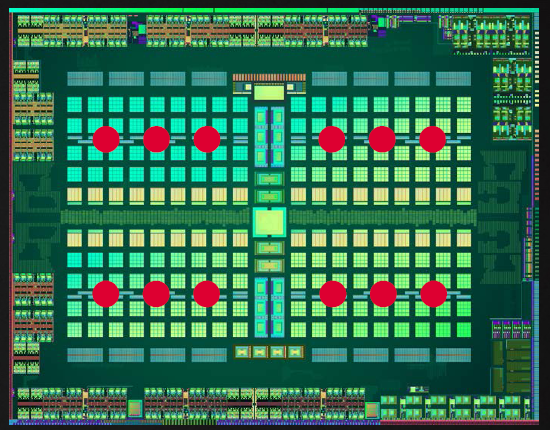

L’architettura GCN di quarta generazione verrà ritrovata, al momento, su due chip: Polaris 10 e Polaris 11. Per questa review, daremo uno sguardo nell’insieme al più grande e performante chip P10, mentre parleremo del P11 in occasione della review della RX 460. In questa iterazione, il processo produttivo (pp) di Samsung a 14nm di tipo FinFET (i transistors sono 3D, non planari) ha permesso di contenere ben 5.6 miliardi di transistors in un die particolarmente compatto.

Per rendere meglio il paragone, abbiamo circa lo stesso numero di transistors della R9 390X nello spazio del processore grafico di una HD 7790. Incredibile, no?

Cosa comportano 5.66 miliardi di transistors in un die di circa 243.3mm²? Beh, un design architetturale che assomiglia molto ad una versione leggermente ridotta di un Hawaii Pro, ma infinitamente più efficiente. Una cosa da evidenziare è che questa è la versione “full size” di Polaris 10, e quindi non ci saranno altre schede “unlocked” o “revisioni” da questo core in particolare.

Sotto una prospettiva di alto livello, Polaris 10 ospita 4 Geometry Processors, ognuno dei quali ospita 9 di 36 Compute units, per un totale di 36 CU. Essi sono configurati in modo da funzionare interconnettivamente grazie all’utilizzo di un GCP, un Graphics Command Processors. Se analizziamo esclusivamente il design del chip, non sono molte le differenze con l’iterazione precedente (quella utilizzata da Tonga e Fiji) della nuova architettura, ma è sotto al “cofano” che si nascondono le modifiche capaci di aumentare le IPC (Instructions-per-clock, praticamente la potenza di calcolo), dove aggiustamenti “micro” consentono l’aumento di efficienza di calcolo “macro”.

Innanzitutto, tra questi cambiamenti figura un miglioramento nel modo in cui ogni Geometry Processor gestisce i carichi di lavoro per ogni blocco. Qui, c’è un enorme salto generazionale ottenuto grazie ad una miglior comunicazione con le unità di calcolo, in modo da eliminare i momenti “morti” nella pipeline di elaborazione.

Anche la gerarchia di caching di Polaris vede alcuni cambiamenti drastici al suo layout: la quantità di cache L2 raddoppia arrivando a 2 MB, praticamente raddoppiando la quantità presente in Hawaii, e nonostante alcune delle cache per le istruzioni siano state “sparse” su tutto il die, la banda passante è stata migliorata e in alcuni casi duplicata. Ciò è particolarmente importante in quanto una maggiore efficienza di caching rimuove parte del carico dal bus a 256 bit, che è suddiviso in 8 memory controller da 32 bit.

Una delle aree che non ha visto molti cambiamenti è il Back-End di render: sebbene ci siano stati alcuni aumenti nelle performance di ogni singola ROP, quest’area potrebbe rappresentare un collo di bottiglia, con sole 32 ROP invece di 64 come sulle schede basate su Hawaii e superiori.

Su una prospettiva a larga scala, noterete inoltre che sparisce il blocco relativo alle funzioni TrueAudio, liberando spazio sul die per una maggiore efficienza di calcolo in rapporto alle dimensioni del chip. Questa funzione è adesso gestita direttamente dagli shaders, ma ne parleremo tra poco nel dettaglio. In aggiunta, è presente un nuovo display controller con supporto nativo a HDMI 2.0b e DisplayPort 1.4, insieme ad un blocco multimediale (encoding e decoding di formati video, perlopiù) fortemente rivisto.

Ultima novità ma non per importanza, la possibilità di apportare modifiche firmware tramite driver, grazie alla quale sarà possibile “evolvere” Polaris ogni qualvolta saranno richieste nuove funzionalità. Tale procedura è stata utilizzata per cambiare la gestione di corrente delle fasi e risolvere il problema di alimentazione dei primi giorni.

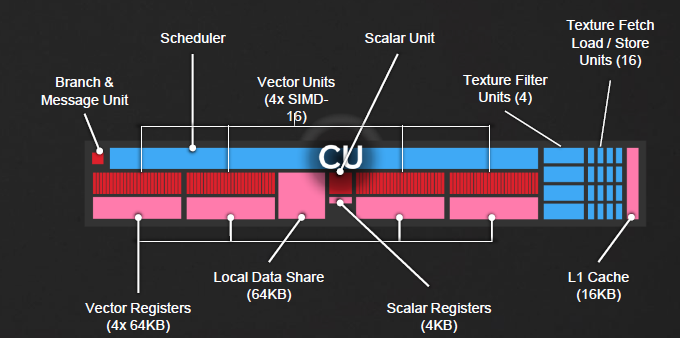

Molti dei cambiamenti di Polaris sono stati effettuati a livello della singola Compute Unit. Così come altri chip basati su GCN, ogni CU include 64 Stream Processors suddivisi in gruppi da 16, quattro cache per registri da 64 KB, 4 unità textures con funzionalità di caricamento e salvataggio ed un blocco di cache L1 dedicata da 16 KB.

La priorità di AMD, a questo giro, è stata di aumentare l’efficienza intrinseca di ogni shader, e ciò è stato ottenuto con un algoritmo migliorato di prefetch delle istruzioni. Esso migliora l’efficienza accorciando “l’occlusione” delle pipeline e rende il caching delle istruzioni più lineare.

Ciò giova anche alle performance in single thread dove i carichi di lavoro non possono essere divisi come con le DX12 o Vulkan, aumentando quindi le prestazioni coi titoli DX11.

Tali miglioramenti portano ad un aumento delle performance clock per clock di circa il 15% rispetto alla R9 390, e questo senza considerare le frequenze operative superiori rispetto a quest’ultima, grazie ovviamente al passaggio ai 14 nm.

Un’altra aggiunta è quella che AMD chiama “Shader Intrinsic Functions”. Esse derivano direttamente dall’esperienza di AMD col mercato console, e sebbene non abbiano molto a che fare con l’architettura Polaris di per sé, le SIF potrebbero avere un impatto drastico sul futuro delle GPU Radeon. Queste estensioni sono essenzialmente trasportate in toto dalle console tramite una libreria API tramite GPUOpen, possono essere “ported” facilmente nel mondo dei PC e possono garantire agli sviluppatori performance superiori grazie alla familiarità con architetture simili.

Hardware Scheduler rinnovato, Primitive Discard Accelerator e Color Compression–>

Se avete letto fin qui, dovrebbe essere evidente che Polaris è molto più che un’ulteriore evoluzione per l’architettura GCN di AMD. Invece, essa rappresenta un enorme incremento di efficienza delle pipeline che consentono all’attuale e alla prossima generazione di velocizzare i carichi di lavoro. Comunque, ciò che abbiamo descritto nella pagina precedente era solo la punta dell’iceberg.

Come avrete notato nelle settimane scorse, AMD ha sempre paragonato Polaris 10 alle R9 290 e 390, sia da un punto di vista prestazionale che architetturale. Laddove Polaris differisce dalle precedenti generazioni è il fatto che uno dei principi operativi di base è “fai di più con meno”. Ciò è evidente nella quantità di ROP, Shaders e Texture Units; ce ne sono meno di quante ce n’erano precedentemente, eppure sulla carta la RX 480 è destinata a batterle sia in efficienza che potenza.

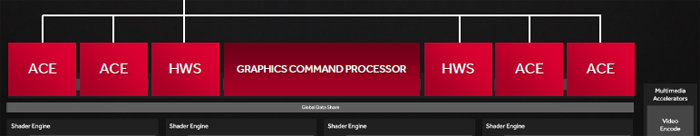

Tale fenomeno è presente anche sul fronte degli ACE (Asynchronous Compute Engines), visto che ne troviamo solo 4 invece di 8 come in Hawaii, ma in realtà dovrebbe esserci un miglioramento nella capacità dell’architettura di processare carichi di lavoro asincroni. Invece di una completa allocazione di ACE, 2 di essi sono stati sostituiti da Schedulers Hardware dedicati. Questi schedulers hanno l’abilità di impegnare una percentuale o intere CU per diversi scopi in modo del tutto dinamico.

Questa, è la chiave per una corretta gestione temporale e spaziale delle risorse, per la pianificazione di operazioni concorrenti o processi in calcolo asincrono e, forse più importante, per il bilanciamento dinamico del carico tra le varie unità di calcolo. Potete immaginare questi nuovi ACE come Compute Engine “sotto steroidi”, non tanto per la maggior potenza a disposizione quanto più per l’infinita dinamicità con cui gestisce carichi di natura diversa.

Tutto ciò può sembrare un po’ complicato, ma il risultato è un significativo aumento delle performance in contesti asincroni e può anche aumentare la granularità con cui le CU possono essere controllate. Con un hardware Scheduler, un’intera CU o anche una determinata percentuale di ogni CU può essere dedicata ad un compito specifico e scalata proporzionalmente in modo totalmente dinamico.

Per esempio, gli HWS possono utilizzare l’accelerazione TrueAudio Next (che è ora utilizzata per l’audio posizionale in applicazioni VR) su un gruppo di SIMD o un’intera CU a seconda delle risorse richieste da un’applicazione specifica. In parole povere, significa che una porzione minore della GPU starà ferma a fare niente e in questo modo aumenteranno le prestazioni.

Un’altra aggiunta interessante è quella che AMD chiama il Primitive Discard Accelerator. Questa nuova funzione permette ai Geometry Engine di analizzare la geometria di una particolare scena e scartare texture e “triangoli” non necessari, il tutto all’inizio della pipeline.

In pratica, quando il PDA è utilizzato correttamente la GPU non sprecherà risorse renderizzando elementi che non verranno visti dal giocatore. Ciò è particolarmente importante con l’utilizzo dell’AA multi-sampling o qualsiasi anti-aliasing che richiede più passaggi e quindi, i guadagni prestazionali sono maggiori quanto più è elevato il livello di AA utilizzato.

C’è anche una nuova Index Cache che agisce come un punto d’accesso rapido per istruzioni geometriche più piccole. Essenzialmente, questa cache limita la quantità di informazioni che si spostano da una pipeline all’altra, liberando bandwidth interna. Combinata con il PDA, Polaris 10 può offrire, teoricamente fino a 3.5 volte le prestazioni della precedente generazione.

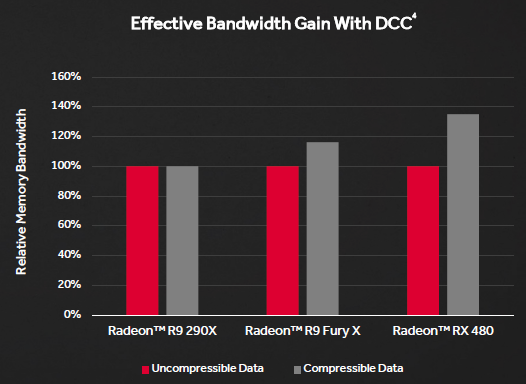

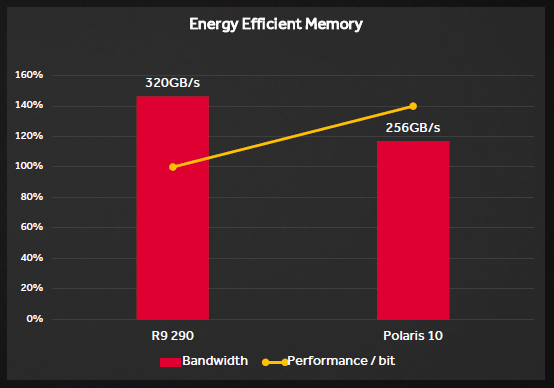

Sebbene le GDDR5 non possano offrire i benefici di banda delle HBM o le GDDR5, AMD ha comunque trovato un modo per aumentare il throughput senza adattare l’architettura ad uno standard di memorie più costoso. Senza nemmeno aumentare l’ampiezza del bus (occupando così un’area maggiore e, quindi, generando più calore), l’unico passo da fare è stato quello di migliorare gli algoritmi di compressione colore, nel tentativo di aumentare l’efficienza piuttosto che semplicemente alzare la banda massima teorica.

Già le precedenti architetture (Fiji e Tonga, soprattutto) includevano una sorta di color compression, ma Polaris alza l’asticella vantando supporto nativo per rapporti di compressione di 2:1, 4:1 e 8:1.

Sebbene il Radeon Technology Group ammetta formalmente che c’è ancora tanta strada da fare per arrivare ai livelli del DCC di NVIDIA, Polaris rappresenta un enorme passo in avanti nel colmare il gap tra le due aziende sotto questo punto di vista.

Allo stato attuale, infatti, gli algoritmi di DCC di AMD permettono ad un bus relativamente ridotto di 256 bit di avere prestazioni molto vicine a quello da 512 di precedente generazione.

Insieme all’enormemente migliorata gerarchia di caching L2 e ai nuovi algoritmi migliorati di DCC, l’interfaccia di memoria di Polaris può non avere un enorme quantitativà di bandwidth, ma è estremamente efficiente. Presumibilmente, l’aumento di performance per bit è di circa il 40%, il che permette sia un risparmio energetico notevole che un miglior utilizzo delle risorse da parte degli sviluppatori.

Efficienza, 14nm e oltre–>

Nell’instancabile missione di AMD nell’ottimizzare l’efficienza delle proprie CPU, GPU e APU, ci sono stati tanti successi quanti fallimenti. Comunque, siamo arrivati al punto in cui i progressi tecnologici di una categoria confluiscono in un’altra. Questo “innesto” ha portato Polaris ad incorporare molte funzionalità di risparmio energetico tipiche delle APU.

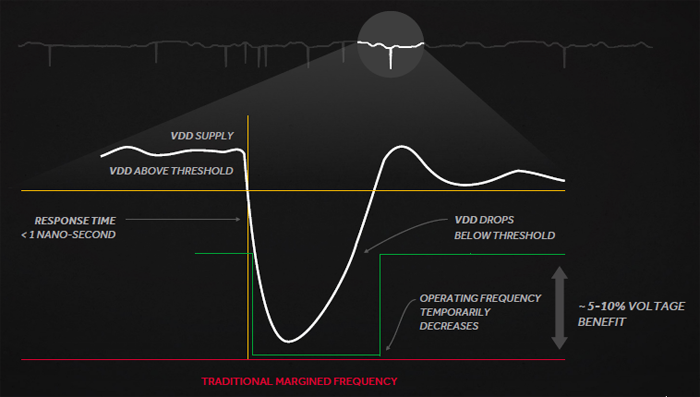

Una di queste tecnologie è definita da AMD come “Adaptive Clocking”. Essa permette di avere amperaggi maggiori a voltaggi minori, minimizzando il vDrop. In questo caso, la frequenza può essere bilanciata dinamicamente per pareggiare le fluttuazioni del voltaggio quasi istantaneamente, in modo da avere frequenze operative maggiori, visto che gli ingegneri di AMD non devono così sottostare al voltaggio minimo comune.

L’Adaptive Clocking porta Polaris a massimizzare le prestazioni a voltaggi inferiori, con conseguenti e significativi risparmi energetici. Esso esiste all’interno degli algoritmi PowerTune stessi, risultando totalmente trasparente all’utente finale.

Così come le APU Carrizo e Bristol Ridge (di recentissima introduzione), Polaris rileva voltaggio, corrente e temperature da diversi punti della GPU. I cosiddetti Adaptive Voltage e Frequency Scaling non solo aiutano l’architettura ad “estrarre” la massima frequenza in ogni momento, ma determina inoltre un ottimo range operativo prima che uno dei treshold (i limiti di temperatura, voltaggio e/o corrente imposti) vengano superati. Essi prendono inoltre azioni preventive, pertanto le estreme fluttuazioni di frequenza riscontrate finora sono solo un fantasma di un Natale passato.

Tutti questi elementi scalfiscono solo la superficie di ciò che Polaris ha da offrire in termini di risparmio energetico, e i benefici complessivi sono significativi. AMD ha stimato che il passaggio ad un nuovo processo produttivo influisca per il solo 70% del nuovo rapporto performance/watt, mentre un ulteriore 110% è stato ottenuto tramite l’utilizzo delle suddette tecnologie finora descritte ed una migliore gestione driver delle risorse. Il risultato finale è un rapporto performance/W 2.8 volte più alto, che è impressionante oltre ogni immaginazione.

Configurazione di prova e metodologia di test–>

La configurazione utilizzata per i test è la seguente:

| CPU | Intel Core i7 5960x |

|---|---|

| Heatsink | Corsair H110i GTX AIO |

| Mainboard | ASRock X99 WS-E/10G |

| RAM | Corsair Vengeance LPX DDR4 3000MHz 32GB |

| VGA | AMD Radeon RX 480 8GB Reference |

| Sound Card | Creative SoundBlaster E5 DAC & AMP |

| HDD/SSD | Corsair Neutron XT 480GB |

| PSU | Corsair AX1500i Digital PSU |

| Case | Corsair Graphite 780T Arctic White |

| Monitor | Acer CB280HK 4K Display |

| Keyboard | Corsair Gaming STRAFE RGB Cherry MX Silent |

| Mouse | Corsair Gaming Scimitar RGB Optical Mouse |

| OS | Windows 10 Pro TH 2 x64 |

Ecco la suite di benchmark (e giochi) con cui testeremo la scheda video:

- Unigine Heaven Benchmark 4.0 (DirectX11)

- Futuremark 3DMark Fire Strike (DirectX11)

- Futuremark 3DMark Fire Strike Extreme (DirectX11)

- Futuremark 3DMark Fire Strike Ultra (DirectX11)

- Futuremark 3DMark Time Spy (DirectX12)

- Bioshock Infinite (Benchmark integrato) (DirectX11)

- Metro Last Light (Benchmark integrato) (DirectX11)

- Terra di mezzo: Ombra di Mordor (Benchmark integrato) (DirectX11)

- Grand Theft Auto V (GTA V) (Benchmark integrato, media dei risultati di 5 scene) (DirectX11)

- Rise of the Tomb Raider (Benchmark integrato) (DirectX12)

- Hitman (2016) (Benchmark integrato) (DirectX11 e 12)

- Doom (2016) (Primo livello, subito dopo l’inizio del gioco) (Vulkan)

- Ashes of the singularity (Benchmark integrato, Crazy Preset) (DirectX11 e 12)

Dove disponibile la scelta della risoluzione, i test sono stati eseguiti ai seguenti valori. Laddove si trattasse di un benchmark, le modalità predefinite sono state utilizzate:

- 1920×1080, AA x4 (Full HD)

- 2560×1440, no AA (2K, QWHD)

- 3840×2160, no AA (4K, UHD)

Qui di seguito le VGA testate con la nuova piattaforma:

- Sapphire AMD Radeon R7 250X Vapor-X OC 1GB (Cape Verde XT, 1100/1300) – Recensione

- Sapphire AMD Radeon R9 290X Tri-X OC 8GB (Hawaii XT, 1020/1375) – Recensione

- Sapphire AMD Radeon R9 290X Tri-X Vapor-X 4GB (Hawaii XT, 1080/1410) – Recensione

- Sapphire AMD Radeon R9 290X Tri-X Vapor-X 8GB (Hawaii XT, 1030/1375) – Recensione

- Sapphire AMD Radeon R9 290X Tri-X Vapor-X 4GB (CrossFireX) (Hawaii XT, 1080/1410, 2 GPU) – Recensione

- Sapphire AMD Radeon R9 290X Tri-X Vapor-X 4GB (CrossFireX) (Hawaii XT, 1080/1410, 3 GPU) – Recensione

- Sapphire AMD Radeon R9 380 Nitro 4GB (Tonga, 985/1450) – Recensione

- Sapphire AMD Radeon R9 380 Nitro 4GB w/Backplate (CrossFireX) (Tonga, 1010/1450, 2 GPU) – Recensione

- Sapphire AMD Radeon R9 380X Nitro 4GB (Antigua XT, 1040/1500) – Recensione

- Sapphire AMD Radeon R9 390 Nitro 8GB (Grenada Pro, 1010/1500) – Recensione

- ASUS AMD Radeon R9 390 8GB Strix DirectCU III (Grenada Pro, 1070/1500) – Recensione

- Sapphire AMD Radeon R9 390X Tri-X 8GB (Grenada XT, 1055/1500) – Recensione

- Sapphire AMD Radeon R9 390X Tri-X 8GB 2CFX (Grenada XT, 1055/1500) – Recensione

- Sapphire Radeon R9 Fury Tri-X OC 4GB HBM (Fiji, 1040/1000) – Recensione

- Sapphire Radeon R9 Fury Tri-X Nitro 4GB HBM (Fiji, 1050/1000) – Recensione

- AMD Radeon RX 480 8GB Reference (Ellesmere XT, 1266/2000) – Recensione

- Gigabyte NVIDIA GeForce GTX950 WindForce (Maxwell GM-206-250, 1279/1753) – Recensione

- MSI NVIDIA GeForce GTX960 Twin Frozr V Gaming 2GB (Maxwell GM-206-300, 1241/1753) – Recensione

- MSI NVIDIA GeForce GTX970 Twin Frozr V Gaming 4GB (Maxwell GM-204-200, 1140/1753) – Recensione

- ASUS NVIDIA GeForce GTX980 Strix OC 4GB (Maxwell GM-204-400, 1178/1753) – Recensione

- NVIDIA GeForce GTX980 4GB (reference) (Maxwell GM204-400, 1127/1753) – Recensione

Test sintetici: Unigine Heaven 4.0 (DirectX 11)–>

Heaven, prodotto da Unigine è stato il primo Benchmark DX11. Lo scopo principale è quello di mettere in risalto gli straordinari effetti della Tessellation. Difatti dai semplici modelli osservabili con tessellation disattivata, si arriva ad oggetti ricchi di profondità e sporgenze senza dover creare trame complesse.

Il compito di arricchire il modello è lasciato all’unità tessellatrice, per cui si tratta di uno strumento indispensabile per valutare l’efficienza dei questa unità nelle moderne soluzioni DX11:

Test sintetici: FutureMark 3DMark Fire Strike (DirectX 11) e Time Spy (DirectX 12)–>

In concomitanza con il lancio di Windows 8, Futuremark ha lanciato il nuovo 3DMark, chiamato appunto 3DMark, senza alcun numero riconoscitivo, a segnare la forte integrazione che ha con qualsiasi sistema, da Android a Windows a iOS a OSX, dando per la prima volta la possibilità di paragonare le prestazioni su smartphone e PC fisso in maniera schematizzata e professionale. Il benchmark dispone di svariati test, di cui utilizziamo i più intensivi per mettere alla prova le schede video.

Tra questi, il più impegnativo è il Fire Strike, che spinge la tessellazione a livelli davvero elevati, e che “vanta” due versioni ancora più spinte: Extreme (con scene pre-renderizzate a 2560×1440) ed Ultra (scene pre-renderizzate a 3840×2160, ovvero 4K).

Recentemente, invece, è stato introdotto il benchmark Time Spy, che testa le prestazioni delle GPU sfruttando le nuove API Microsoft DirectX 12, con scene pre-renderizzate a 2560×1440:

Test sui giochi: Bioshock Infinite (DirectX 11)–>

Continuiamo con Bioshock Infinite, che ci mette nei panni di Booker DeWitt, un investigatore privato, un tempo agente Pinkerton, incaricato di ritrovare una ragazza, Elizabeth, tenuta prigioniera a Columbia, una fantomatica città sospesa nei cieli, dove le modifiche genetiche sono considerate veri e propri beni di lusso. Per la prima volta nella serie di Bioshock, il personaggio ha un volto, un nome ed una storia precedente al gioco, che verrà svelata con l’avanzare della partita.

Il gioco supporta le API DirectX 11, con le quali supporta tecnologie quali: High Definition Ambient Occlusion, Contact Hardening Shadows e Diffusion Depth of Field. È implementato inoltre il supporto all’FXAA (anti-aliasing ad approssimazione rapida) ottimizzato per l’utilizzo su SM 5.0. Il gioco è ottimizzato per architetture AMD, in quanto parte del programma AMD Gaming Evolved.

Test sui giochi: Metro Last Light (DirectX 11)–>

Dopo l’incredibile successo di Metro 2033, ecco che fa capolino sugli schermi dei nostri PC il suo successore, Metro Last Light, basato sul romanzo Metro 2034 di Dmitry Glukhovsky, che vede il mondo alle prese con i postumi di una terza guerra mondiale atomica, con tutto ciò che ne consegue: la popolazione ancora in vita in Russia si è trasferita nella famigerata metropolitana russa, dotata di 298 km di binari e tunnel sotto Mosca.

Ancora una volta, il giocatore rivestirà i panni di Artyom, per impedire una guerra civile che potrebbe portare alla fine il genere umano. Tecnicamente parlando, il gioco è incredibilmente pesante, sia per poligoni a schermo che per requisiti, facendo uso di tutte le tecnologie introdotte dalle DirectX11: Depth of Field, HDAO, Tessellation e real-time Motion Blur. Il gioco è ottimizzato per schede video NVIDIA, dato il supporto all’NVIDIA PhysX e in quanto parte del programma NVIDIA – The Way It’s Meant To Be Played.

Test sui giochi: Middle Earth: Shadow of Mordor (DirectX 11)–>

Chi è appassionato della saga di J.R.R. Tolkien sa che, fino a Settembre 2014, non esisteva un gioco degno di tal nome che narrasse le vicende della Terra di mezzo. Grazie a Monolith e ai Warner Studios, però, ora la collana fantasy più famosa del globo terracqueo vanta un gioco tripla A, forte di una trama travolgente, una grafica sul filo del fotorealismo ed un sistema di combattimento che sembra l’evoluzione del Free Form Fighting System visto in Prince of Persia: Spirito Guerriero. Il risultato?

Un titolo must-have, il cui motore grafico si rifa a quello utilizzato da Batman: Arkham Origins, titolo che sostituisce nella nostra suite di benchmarks. Il gioco è ottimizzato per schede video NVIDIA, dato il supporto all’HBAO, all’SMAA e più in generale a tutti i GameWorks dell’azienda. Il gioco, soprattutto alle alte risoluzioni e con i filtri al massimo, richiede un quantitativo di memoria video non indifferente, e pertanto risulta pienamente indicato qualora voleste mettere alla prova schede video con un quantitativo VRAM maggiore:

Test sui giochi: Grand Theft Auto V (DirectX 11)–>

Grand Theft Auto. Una saga che affonda le sue radici nel sangue e nella violenza in visuale dall’alto e 2 dimensioni, e che nell’ultima iterazione, attesa per ben 8 lunghissimi anni dagli utenti PC. Nel 2015, dopo ben 8 anni di attesa (per gli utenti PC), GTA V ha visto la luce sugli schermi dei computer di tutti i videogiocatori, distruggendo record su record in vendite e profitti.

Un approccio totalmente diverso, quello per la storia: tre personaggi controllabili, ognuno più folle dell’altro, tra mafia, sparatorie, esplosioni e rapine spettacolari. Il gioco è ottimizzato per schede video NVIDIA, presentando il supporto a tutti i GameWorks dell’azienda eccezion fatta per gli Hairworks. Ad alte risoluzioni, il gioco è un vero e proprio campo di battaglia dove testare le schede video più potenti:

Test sui giochi: Rise of the Tomb Raider (DirectX 12)–>

Lara Croft fa il suo ritorno nel secondo titolo reboot della saga di Tomb Raider, in The Rise of the Tomb Raider (o RotTR se vi piacciono gli acronimi), uno dei primi giochi DirectX 12 che vedono l’eroina dei nostri solitari pomeriggi razziare tombe in giro per il mondo, cercando di risolvere il mistero dietro la morte del padre.

Il gioco è ottimizzato per schede video NVIDIA, presentando il supporto a tutti i GameWorks dell’azienda eccezion fatta per gli Hairworks, sostituiti dai PureHair, tecnologia direttamente derivata dallo standard TressFX di AMD, e si avvale sia delle DirectX 11 che delle DirectX 12 e dell’Async Computing per il rendering:

Test sui giochi: Hitman (2016) (DirectX 12)–>

Ancora un altro reboot, e stavolta è l’agente 47 a vedere una “rinascita”, con Hitman (2016), che ci vede alle prese con un più giovane, più freddo Agente 47, alle prese con diversi “episodi” (ed è proprio il modello di vendita del titolo, episodi che vengono pubblicati col passare del tempo) e vari obiettivi da uccidere, come da tradizione.

Il gioco è ottimizzato per schede video AMD, presentando il supporto alle DirectX 12, all’Async Computing e all’SSAO, ovviamente supportando anche le DirectX 11:

Test sui giochi: Doom (2016) (Vulkan)–>

Probabilmente a corto di idee, Bethesda si aggiunge alla sfilza di software house che in questi anni ha sfornato l’ennesimo reboot/remaster/remake di titoli famosi. Questa volta tocca a Doom, famigerato First Person Shooter, che nel 1993 segnò (insieme a Wolfenstein 3D) la nascita dei giochi in 3 dimensioni che oggi tanto amiamo. In controtendenza, il reboot della serie non è sotto le aspettative, e presenta tanto, tantissimo (forse troppo? Nah, non è mai troppo) sangue, con Epic Kills e tanti demoni da ammazzare.

Il gioco è ottimizzato per schede video AMD, e contrariamente al resto dei giochi in commercio, opera tramite API OpenGL, e, più recentemente, Vulkan, che forniscono un incredibile vantaggio alle GPU di ultima generazione:

Test sui giochi: Ashes of the singularity (DirectX 12)–>

Spezzando il filone di reboot e rifacimenti di giochi vetusti, Ashes of the Singularity è quello che Stardock (la software house creatrice del gioco) definisce come un gioco strategico di warfare planetario, e con le sue mappe enormi e le migliaia di unità a schermo durante i combattimenti full-scale, non si può far altro che dare ragione all’azienda.

Ciò che viene spesso associato ad Ashes è l’incredibile onere che applica ai sistemi grafici (e non solo, il gioco è famelico di core e GHz), tramite l’utilizzo di DirectX 11 e 12. Il preset Crazy è in grado di mettere in ginocchio qualsiasi GPU in commercio già alla risoluzione Full HD. Il gioco si avvale del supporto alle tecnologie AMD, prendendo spunto dal motore grafico Nitrous utilizzato in uno dei primi benchmark per Mantle, Star Swarm:

WattMan, overclock, temperature–>

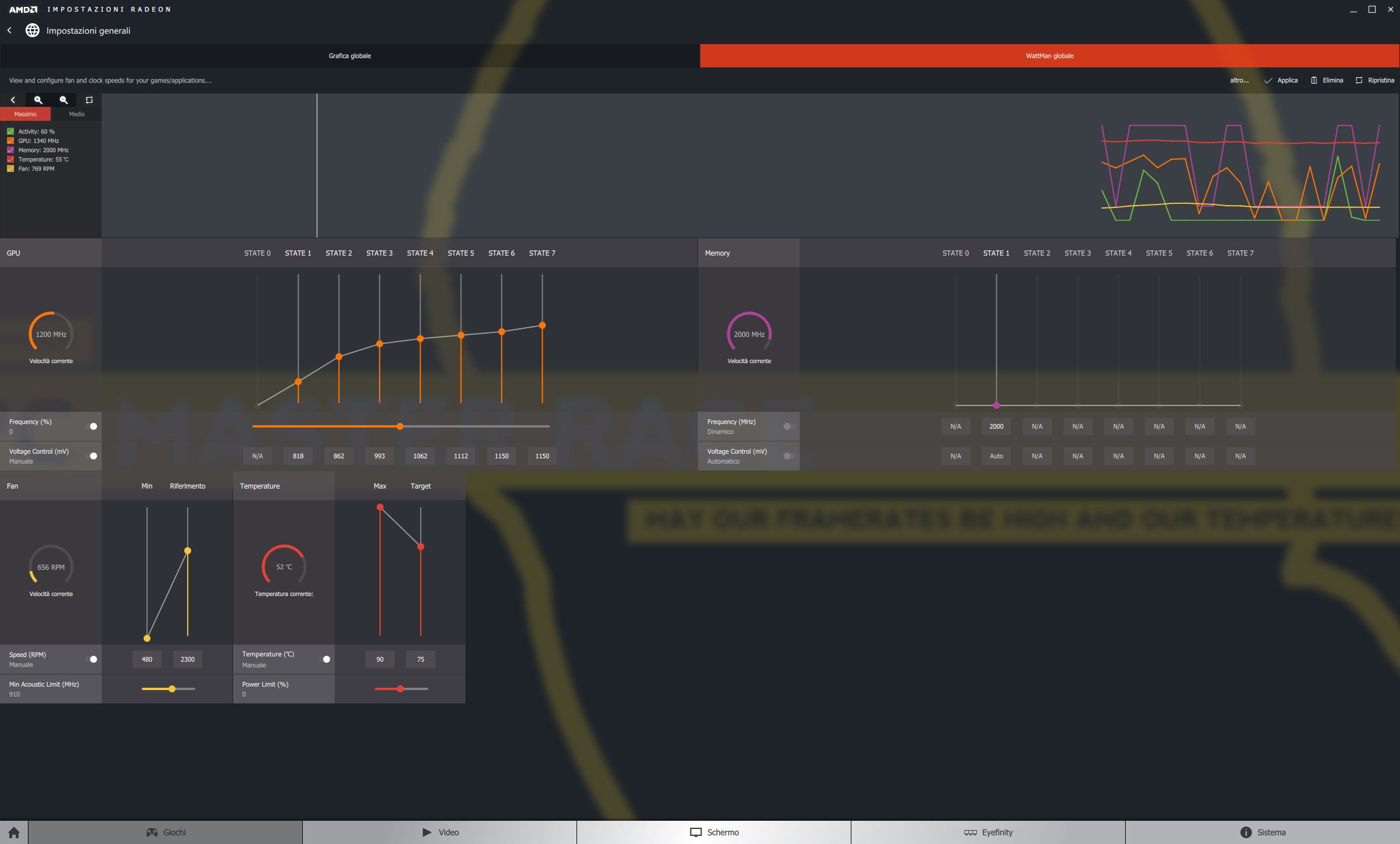

Con Polaris, AMD introduce un nuovo pannello di controllo all’interno dei Radeon Crimson Driver, denominato WattMan (letteralmente, l’uomo Watt). Di seguito, l’interfaccia del pannello di gestione:

(ndr: la schermata è stata catturata con una RX 480 Nitro+ OC 8GB di Sapphire, non è il modello reference) Come è evidente, rispetto alla vecchia schermata di controllo AMD Overdrive, la compagnia ha adottato un approccio molto più serio e metodico all’overclock e all’overvolt delle proprie GPU.

Da un grafico a due assi per tutti gli aspetti che concernono la gestione termica, elettrica e delle frequenze si passa ad una serie di menu che si spartiscono il compito di gestire frequenza e voltaggi secondo i vari State (pensateli come lo SpeedStep di Intel, che regola dinamicamente le frequenze in base al tipo di utilizzo), consentendo maggiore flessibilità sul fronte della gestione dell’overclock, dell’overvolt (o addirittura undervolt) e della velocità della ventola del dissipatore reference (che ricordiamo essere di tipo blower).

È adesso impostabile un target di temperatura su cui la GPU si aggiusterà automaticamente tramite gli algoritmi del PowerTune, impostando ovviamente un tetto massimo e regolando le specifiche elettriche e termiche di conseguenza. Con questa generazione di GPU, AMD introduce il suo concetto di Boost Clock, che vediamo su schede NVIDIA da diverse generazioni (dalla serie GTX6xx in poi), che vede la scheda oscillare tra il clock minimo di 1120 MHz e il clock massimo di 1266 MHz. A differenza di NVIDIA, però, la scheda non cercherà di trovare la massima frequenza stabile date le condizioni di temperatura, voltaggio e power limit, ma semplicemente murerà ai suddetti 1266 MHz.

Onestamente, piuttosto che effettuare overclock su una scheda reference, dotata di un dissipatore poco efficiente (e particolarmente rumoroso se spinto oltre i valori di fabbrica), ho voluto sperimentare ciò che molti utenti sul subreddit /r/AMD hanno testato ampiamente: l’undervolt.

Come già detto in precedenza, la scheda presenta consumi superiori alla concorrenza, complice il fatto che AMD ha fatto poco binning sulle GPU utilizzate per le schede: infatti, è stato riscontrato su un campione abbastanza vasto che tutte le GPU operano allo stesso voltaggio, non operando quindi in base alle specifiche necessarie alla stabilità, ma invece portando con sé voltaggi superiori del 7-15%.

Il risultato? Nel nostro caso, il decremento con cui la scheda è risultata comunque perfettamente stabile è di 67 mV (7%, considerando che a default la scheda operava a 1087 mV), portandola quindi a 1.02 V esatti e abbassando quindi consumi e calore.

Inoltre, visto che il PowerTune agisce in base ai valori rilevati, un abbassamento del calore generato e dei consumi ha portato la GPU ad utilizzare pressoché sempre la massima frequenza di 1266 MHz, allontanando ogni pericolo di Throttling.

Avremmo potuto anche fare overclock sul nostro sample, ma preferiamo lasciare tale compito ai modelli custom (stiamo lavorando alla recensione della Nitro+ OC da 8GB di Sapphire) l’arduo compito di spingere Polaris 10 oltre i limiti di fabbrica.

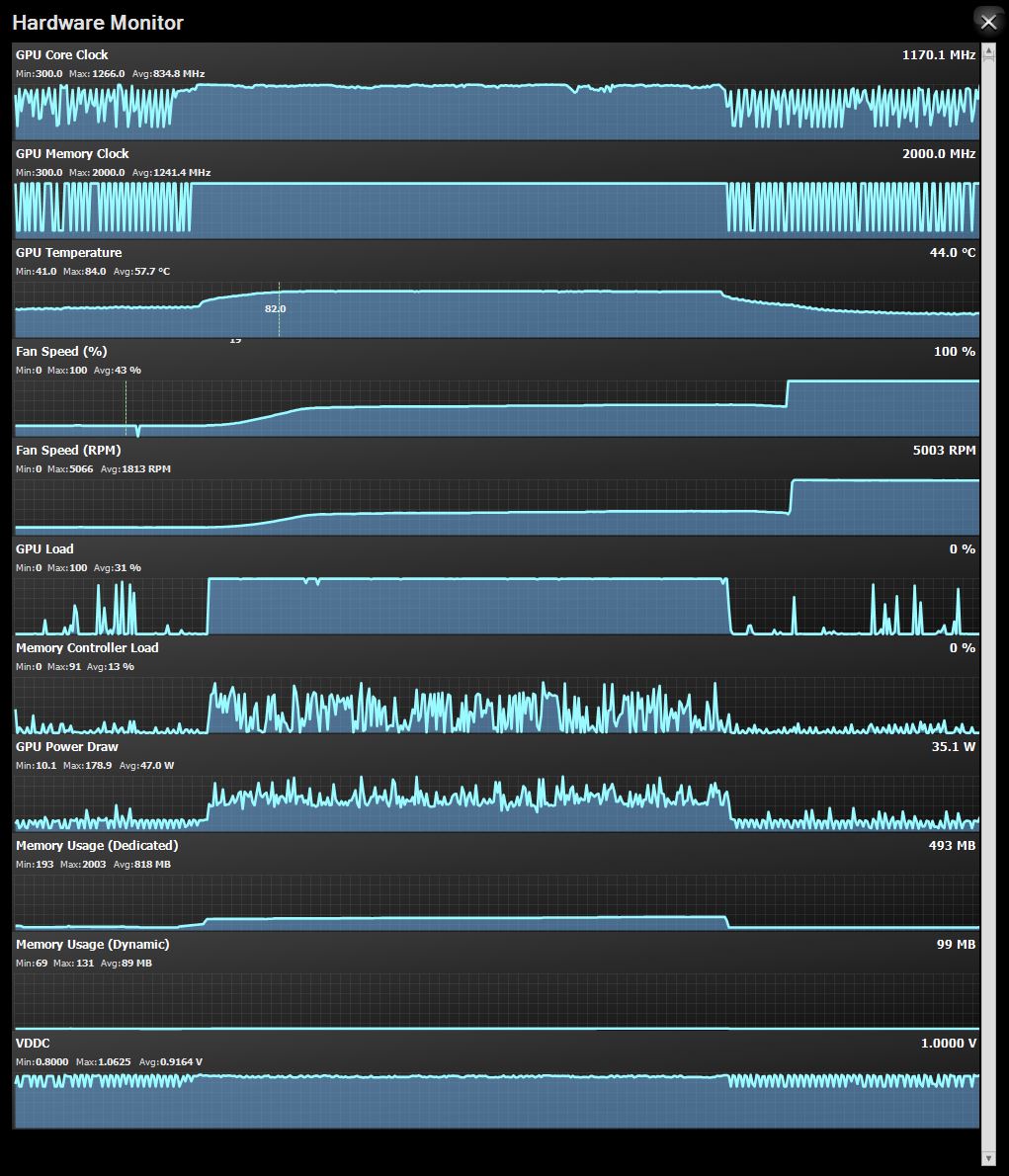

Di seguito, le temperature rilevate:

Come vedete, la temperatura minima, con una T.Amb. di 32°C, è di 41 °C, mentre quella massima è di 84 °C. Tali valori sono stati riscontrati eseguendo Heaven 4.0 in 4K ed impostazioni grafiche massime. Portando la ventola al 100%, e toccando quindi ben 6000 RPM, siamo scesi a 68 °C, con un’acustica però difficilmente sostenibili per lunghi periodi, persino con cuffie che isolano dal rumore esterno con volumi moderati d’ascolto. Insomma, se volete una GPU fresca, forse dovete puntare ad un modello custom e non quello reference.

Il consumo di picco rilevato da TriXX 6.0 è invece di circa 180 W, superando i 150 W di Typical Board Power dichiarati dall’azienda.

Considerazioni finali–>

[conclusione]

[titolo]Design e qualità costruttiva[/titolo]

Il design richiama direttamente quello della Fury X e della R9 Nano, con materiali però di fattura inferiore: il metallo lascia spazio quasi esclusivamente alle plastiche ABS, che però risultano robuste nonostante siano materiali “meno nobili”. Il dissipatore blower style è davvero di scarsa potenza, e per una scheda di questo wattaggio e fascia di prezzo, è più che comprensibile, ma qualora vogliate migliorare le temperature o, perché no, fare un po’ di overclock sulla scheda, il rumore diventa difficilmente sopportabile.

Le dimensioni del PCB sono compatte, e infatti il dissipatore sporge per alcuni centimetri dopo di esso, lasciando il connettore PEG a 6 pin a 3/4 di scheda: soluzione inestetica ma funzionale, soprattutto rispetto a quella adottata da NVIDIA, soprattutto qualora vogliate adottare dissipatori aftermarket o waterblock per raffreddare in maniera più efficiente la scheda.

[voto=”9″]

[/conclusione]

[conclusione]

[titolo]Prestazioni[/titolo]

Una scheda da 239$ (che si traducono, sfortunatamente per noi europei, in circa 250€) con prestazioni a metà tra una R9 390 (300€) ed una R9 390X (370€) e consumi praticamente dimezzati? Sì, la RX 480 è questo. Oltre agli infiniti benefici della miglior efficienza del chip, le varie tecnologie a supporto delle nuove API DX 12 e Vulkan fanno sì che la scheda si comporti meglio delle controparti NVIDIA, risaputamente castrate con i meccanismi di Async Computing utilizzati da queste nuove librerie grafiche.

Un occhio di riguardo va volto a DOOM, unico gioco del nostro set di test che utilizza Vulkan: nonostante la grafica impostata in modalità Incubo, il gioco girava abbondantemente sopra i 60 FPS in Full HD, mentre in 2K la totale stabilità (i 60 FPS, appunto) viene raggiunta con uno scarto del 5%, rendendo il gioco più che godibile anche a risoluzioni maggiori. A dirla tutta, eccezion fatta per Rise of the Tomb Raider, gioco particolarmente pesante e considerato il nuovo “Crysis” in termini di requisiti grafici, la scheda riesce a mantenere i 60 FPS (circa) con tutti i giochi, partendo da Bioshock Infinite fino ad arrivare a Hitman, passando per GTA V, titolo risaputamente gravoso in termini di risorse.

Dati alla mano, però, la scheda avrebbe potuto avere prestazioni superiori, semplicemente duplicando il numero di ROP a disposizione (che ricordiamo essere 32 invece di 64 come su Hawaii e superiori), castrando inevitabilmente le risorse sopra i 2K. In 4K, infatti, la scheda presenta framerate medi tra 20 e 40 FPS, non rendendo l’esperienza di gioco appetibile.

Poco male, però: la RX 480 non è una scheda per 4K e AMD l’ha sempre chiarito.

[voto=”9″]

[/conclusione]

[conclusione]

[titolo]Compatibilità e consumi[/titolo]

La scheda presenta un connettore PCI-E 16x elettrico e meccanico Gen3, risultando compatibile con tutte le schede madri Intel degli ultimi anni e con i sistemi AMD di ultima generazione. I consumi dichiarati dall’azienda sono di circa 150 W medi, ma picchi di 170-180W sono comunque raggiungibili in situazioni di utilizzo estremo. Pertanto, consigliamo l’utilizzo di alimentatori da almeno 400 W, e qualora vogliate effettuare overclock, di munirvi di un alimentatore leggermente più grande e di un dissipatore aftermarket per la scheda, visto che quello reference non è dei migliori.

[voto=”9″]

[/conclusione]

[conclusione]

[titolo]Prezzo[/titolo]

Il prezzo? Beh, è la ciliegina sulla torta: la AMD Radeon RX 480 in USD costa 239$, che in Europa (in particolar modo, in Italia) si traducono in circa 270€. Certo, negli U.S. sono avvantaggiati dal fatto che la scheda occupa la fascia inferiore di prezzo, ma anche qui in Italia acquistarne una conviene sia in termini prestazionali che economici, in virtù del fatto che le prestazioni rilevate sono a metà tra una scheda di 300€ ed una di 370€. Promossa a pieni voti.

Vi invitiamo ad acquistare presso i rivenditori ufficiali AMD, in quanto pur presentando un prezzo superiore ai VAT Player (coloro che evadono l’iva tramite meccanismi al limite della legalità), forniscono supporto post-vendita/RMA, cosa che suddetti rivenditori non ufficiali non garantiscono.

[voto=”10″]

[/conclusione]

In conclusione, la Radeon RX 480 di AMD è un’ottima base di partenza per quelli che saranno i modelli custom dei vari AIB partner (e abbiamo tra le mani il modello Nitro+ OC di Sapphire, sappiamo di cosa stiamo parlando). Detto questo, diamo alla scheda il nostro Hardware Platinum Award insieme al Best Price Award per l’incredibile rapporto prezzo/prestazioni:

|

|

Ringraziamo AMD e Edelman Italia per il sample oggi recensito.

Per oggi è tutto da ReHWolution, non dimenticate di seguirci sui nostri social network:

La recensione

AMD Radeon RX480 Polaris Reference

La Radeon RX 480 di AMD è una scheda economica, veloce, che consuma meno dei predecessori e che distrugge la concorrenza con Vulkan e DirectX 12. Sarà abbastanza per riprendere quote di mercato, per l'azienda?

Pro

- Supporto avanzato alle nuove librerie DirectX 12 e Vulkan

- Economica

- Prestazioni tra la R9 390 e la R9 390X

- Consumi inferiori rispetto alla generazione precedente...

Contro

- ...ma ancora superiori alla concorrenza

- Dissipatore reference che lascia a desiderare

AMD Radeon RX480 Polaris Reference Prezzi

Raccogliamo informazioni da vari negozi per indicare il prezzo migliore